-

질문 & 답변

카테고리

-

세부 분야

자연어 처리

-

해결 여부

미해결

PEFT 실습 4에서 training시작할때 out of memory가 발생합니다.

23.11.13 16:49 작성 조회수 162

0

PEFT 실습 4에서 training시작할때 out of memory가 발생합니다.

모두를 위한 대규모 언어 모델 LLM(Large Language Model) Part 1 - Llama 2 Fine-Tuning 해보기

PEFT 실습 4 - BLOOMZ Casual Language Modeling 모델에 Prompt Tuning 적용하기 (twitter_complaints 데이터셋)

강의실 바로가기

답변을 작성해보세요.

0

AISchool

지식공유자2023.11.14

안녕하세요~. 반갑습니다.

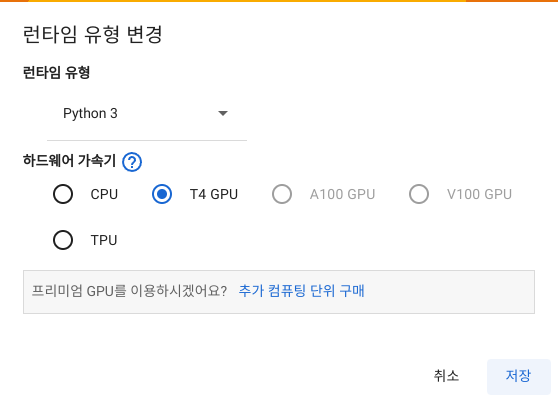

실습을 위해 제공드린 colab 코드에서 colab에서 무료로 사용할 수 있는 GPU 사양인 T4 GPU로 문제없이 학습이 진행되는 것을 확인하였는데요.

혹시 개인 GPU를 이용해서 학습중 Out of Memory 문제가 발생할 경우 아래 batch_size = 8 부분을

batch_size = 8batch_size = 2와 같이 배치 사이즈를 더 작은 값으로 설정해서 트레이닝을 시도해보시기 바랍니다.

좋은 하루 되세요.

감사합니다.

Dopamine Um

질문자2023.11.14

혹시 batch_size랑 별개로, num_epochs 크기도 메모리에 영향이 있을까요?

num_epochs는 예제값 50보다 높거나 낮추면 정확도에만 영향이 가나요?

답변 1