무료

중급자를 위해 준비한

[데이터 분석] 강의입니다.

강화학습의 이론, 기초 개념을 탄탄히 다지고 싶은 분, 딥러닝이 강화학습에 어떻게 적용 되는지 배우고 싶으신 분께 도움이 됩니다.

✍️

이런 걸

배워요!

이런 걸

배워요!

강화학습 논문 읽기

강화학습 기초 이론

Policy, Reward, MDP, Monte-Carlo, Temporal Difference 등... 강화학습 관련 논문이나 프로젝트에서 흔히 접하게 되는 개념이지만, 각 용어의 정확한 정의를 가장 기초부터 차근차근 설명해주는 강의 자료는 많지 않은 것 같습니다. 이를 단단하게 이해하지 못하고 논문이나 프로젝트에 뛰어 들면 방향키를 잃은 배 처럼 갈 곳을 잃은 채 망망대해를 떠돌게 될 것 입니다.그 기초를 풍부한 설명과 직관적 이해를 겸비하여 가장 잘 설명해주는 자료가 딥마인드의 D.Silver 교수님의 유튜브 강의라고 생각합니다. 하지만 해당 강의는 영어로 진행되고, 초심자가 듣기에 다소 어려운 면이 있어서, 본 강의는 같은 내용을 보다 알기 쉽게 우리말로 풀어서 재전달하는 것을 목적으로 하는 강의입니다. D.Silver의 강의가 10강으로 구성된 것 처럼 저희의 강의 또한 10강으로 이루어질 예정입니다.

도움이 되는 분들

도움이 되는 분들

- 강화학습의 이론, 기초 개념을 탄탄히 다지고 싶은 분

- 딥러닝이 강화학습에 어떻게 적용 되는지 배우고 싶으신 분

알파고 논문 리뷰

알파고 논문 리뷰

강화학습을 배우면 어떤 일을 할 수 있는 지 궁금하신 분들은 저희 팡요랩의 알파고 논문 리뷰 영상을 먼저 봐주세요. 알파고 논문 리뷰: https://www.youtube.com/watch?v=SRVx2DFu_tY&list=PLpRS2w0xWHTfnWmr95LtIu4v4HbVxqTlM

알파고 제로 논문 리뷰: https://youtu.be/CgOGKChwWrw

강화 학습이란?

강화 학습이란?

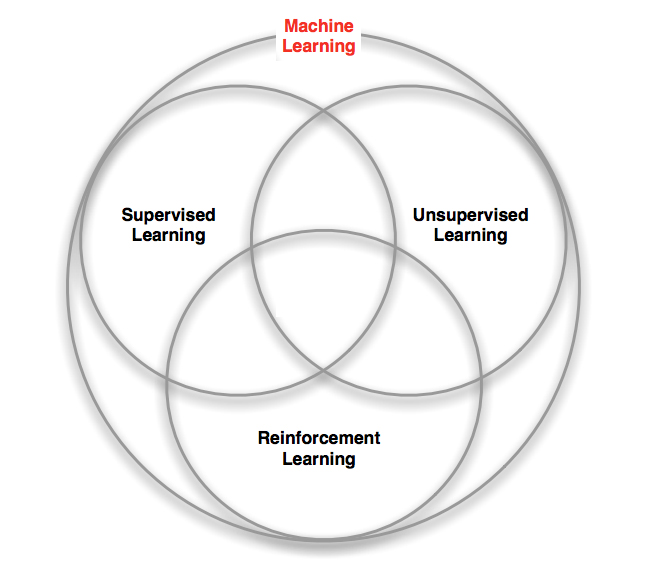

기계학습 (Machine Learning) 분야 중의 하나인 강화학습(Reinforcement Learning)

머신러닝은 크게 지도학습,비지도학습, 강화학습 분야로 나눌 수 있다. 현재의 상태를 인식하여, 선택 가능한 행동들 중 보상을 최대화하는 행동 혹은 행동 순서를 선택하는 방법이다.

머신러닝은 크게 지도학습,비지도학습, 강화학습 분야로 나눌 수 있다. 현재의 상태를 인식하여, 선택 가능한 행동들 중 보상을 최대화하는 행동 혹은 행동 순서를 선택하는 방법이다.

참고 자료

- 강의 슬라이드 http://www0.cs.ucl.ac.uk/staff/d.silver/web/Teaching.html

- David Silver 직강 https://www.youtube.com/watch?v=2pWv7GOvuf0&list=PL7-jPKtc4r78-wCZcQn5IqyuWhBZ8fOxT

- 알파고 논문 리뷰 https://www.youtube.com/watch?v=SRVx2DFu_tY&list=PLpRS2w0xWHTfnWmr95LtIu4v4HbVxqTlM

- 알파고 제로 논문 리뷰 https://youtu.be/CgOGKChwWrw

지식공유자 소개

노승은서울대학교 - 컴퓨터공학, 경제학 전공 (2010-2015)

서울대학교 융합과학기술대학원 - 딥러닝의 하이퍼파라미터 최적화 관련 연구 (2015-2017)

엔씨소프트 AI Research - 강화학습팀 인공지능 연구원 (2017-)

전민영

서울대학교 - 컴퓨터공학, 시각디자인 전공 (2011-2017)

게임베리 - 개발자 (2014)

링글 - 개발자 (2015)

매드업 - 개발자 (2016-2017)

네이버 - Papago팀 프론트엔드 개발 (2018-)

이런 분들께 추천드려요!

🎓

학습 대상은

누구일까요?

학습 대상은

누구일까요?

강화학습을 처음 접하는 사람

📚

선수 지식,

필요할까요?

선수 지식,

필요할까요?

미분

안녕하세요

팡요랩 입니다.

팡요랩 입니다.

커리큘럼

총 10 개

˙ 13시간 2분의 수업

이 강의는 영상, 수업 노트가 제공됩니다. 미리보기를 통해 콘텐츠를 확인해보세요.

섹션 0. 강화학습의 기초 이론

10 강

∙ 13시간 2분

강화학습 introduction

미리보기

01:20:23

Markov Decision Process

미리보기

01:15:36

Planning by Dynamic Programming

01:19:49

Model Free Prediction

01:16:37

Model Free Control

01:06:22

Value Function Approximation

01:19:54

Policy Gradient

01:33:38

Integrating Learning and Planning

01:21:49

Exploration and Exploitation

01:13:10

Classic Games

01:15:22

강의 게시일 : 2018년 09월 19일

(마지막 업데이트일 : 2018년 11월 26일)

수강평

총 18개

수강생분들이 직접 작성하신 수강평입니다.

4.9

18개의 수강평

5점

4점

3점

2점

1점

VIEW

추천 순

최신 순

높은 평점 순

낮은 평점 순

평점 순

높은 평점 순

낮은 평점 순