開発者のためのプロンプトパターン

arigaram

コーディングのための基本プロンプトパターンと、人工知能を活用するための高度なAPIプロンプトパターンを紹介します。

初級

prompt engineering

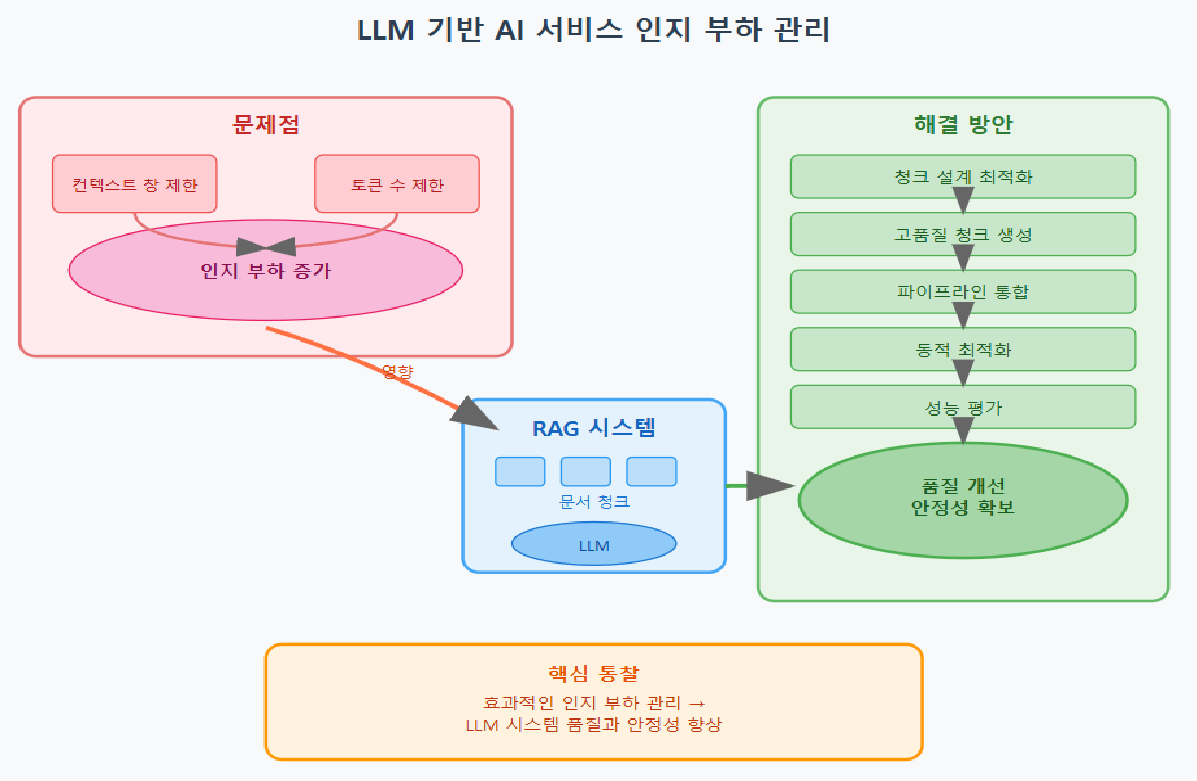

認知負荷(Cognitive Load)理論に基づき、RAGの性能を改善する方策を提示します。従来のRAG性能向上手法の限界を超えるため、認知負荷という思考の枠組みを適用し、さまざまな手法を統合します。

LLMのコンテキストウィンドウとトークンの制限を理解し、管理するための戦略

高品質なチャンク(Chunk)を生成する方法と、RAGパイプラインに統合する方法

現在、講義を完成させている途中です。講義がすべて完成するまで(随時補強は行いますが)、長くお待たせしてしまうという欠点があります。このような点を考慮した上で、購入をご検討ください。

2026年4月22日

第1版を完成させていない状態で、第2版へと全面改訂いたします。既存の第1版のセクションについては、対応する第2版のセクションが完成次第、削除する予定です。

2025年9月4日

各セクションごとの統合要約版を2/3ほどアップロードしました。まだアップロードしていない統合要約版も、近いうちに一つずつアップロードする予定です。

セクション3をセクション3とセクション4に分離していましたが、講義リストのセクション番号と授業資料のセクション番号が一致せず混乱を招く可能性があるため、セクション4をセクション31(最後尾)に移動しました。

2025年9月1日

セクション3をセクション3とセクション4に分離しました。これに伴い、セクション番号と授業資料の番号が一致しない場合があります。授業資料を修正し、動画を録音し直して再度公開いたします。恐れ入りますが、今しばらくお待ちいただけますと幸いです。

受講生の混乱を減らす方向で目次を再構成しています。これに伴い、8月22日に一時非公開にしていたレッスンを再度公開しました。

2025年8月22日

thoughtful 116 tokens variant <thought> <span style="color:rgb(33, 37, 41)">まだ完成していない[深化]課程に属するレッスン(セクション11〜30)を非公開状態に変更しました。今後、完成次第セクション別またはレッスン別に公開する予定です。受講生の皆様の混乱を避けるための措置ですので、ご理解いただけますと幸いです。</span></thought>

大規模言語モデル(LLM)をベースにAIサービスを構築する手法が主流となりましたが、コンテキストウィンドウのサイズやトークン数に制限があるため、限界が存在します。特にRAG(Retrieval-Augmented Generation:検索拡張生成)システムにおいては、ドキュメントやチャンク(Chunks:文書の断片)を適切に管理できなければ、LLM側に認知負荷が発生し、最適な回答を生成することが困難になります。

認知負荷(cognitive load)とは、システム(人間の脳や人工知能を含む)が処理すべき情報の量や複雑さに応じて、情報を認識しにくくなる度合いを意味します。LLMシステムにおいて認知負荷が高まると、情報が過剰に蓄積されて核心がぼやけ、性能が低下し、期待する水準の回答が得られない可能性があります。したがって、効果的な認知負荷の管理は、LLMベースのシステムの品質と安定性を左右する核心的な要素です。

この講義では、LLMのコンテキストウィンドウの限界と認知負荷の概念に基づき、チャンク設計から高品質なチャンク生成、RAGパイプラインへの統合、動的最適化、そして性能評価に至るまで、実務に即座に適用できる段階的な手法を提示します。これにより、従来の様々なRAG補強手法では解決できなかった回答品質の低下問題を大幅に解決できることが期待されます。

LLMのコンテキストウィンドウとトークン制限による認知負荷管理戦略

高品質なチャンク(Chunk)の生成方法と、多様なチャンキング(Chunking)技法を活用する方策

RAGシステムを構築するためのデータ前処理、検索、プロンプト設計、後処理を統合する技術

動的最適化によるリアルタイムなチャンクサイズの調節および要約パラメータの調節

性能評価指標の適用および結果報告書の作成方法

人工知能(AI)、ChatGPT、LLM、RAG、AI活用 (AX)

最初のセクションでは、本講義の全体的な概要と目標を明確にし、LLMのコンテキストウィンドウと認知負荷管理の基本概念を扱います。特に認知負荷とは何か、LLM環境においてなぜそれが重要なのかを詳細に理解し、RAGの基礎を学習します。理論に基づき、講義で扱う主要なテーマを確認しながら、学習の方向性を定める手助けをします。初心者でも無理なく進められるよう概念を一つずつ丁寧に説明し、その後の高度なトピックへと自然に移行できる強固な土台を築きます。

このセクションでは、LLMのコンテキストウィンドウとトークン化メカニズムを深く分析します。トークンとは何か、どのように分割され、モデルの入力にどのような影響を与えるのかを詳細に確認し、コンテキストウィンドウのサイズの制限がモデルのパフォーマンスにどのような影響を与えるのかを、さまざまな事例とともに説明します。また、トークンに応じたコストを計算する方法を学び、実際のシステム設計時に活用できるよう実務的な感覚を養います。この過程を通じて、トークンとコンテキストに対する体系的な理解に基づき、認知負荷管理の具体的な問題を直感的に把握できるようになります。

効果的なチャンク設計は、RAGシステムの品質の核心です。このセクションでは、固定サイズチャンクから段落ベース、意味単位のクラスタリング、階層構造に至るまで、さまざまなチャンク戦略を紹介し、各手法の長所・短所と適用事例を深く掘り下げます。チャンクのサイズと構造が認知負荷やコンテキストの活用に与える影響への理解に基づき、状況に合わせた最適なチャンク戦略を設計する実践的なノウハウを習得できます。最後には、実習を通じて多様なチャンク方式を適用する経験を積み、理論と実務を有機的に結びつけられるようにします。

このセクションでは、認知負荷を軽減し情報の質を高めるために、より高度なチャンク生成技法を扱います。スマート要約、原文と要約文の結合、埋め込みベースのクラスタリング、メタタグ付与、質問意図の反映といった多様な技術を学び、各技法を組み合わせてより効率的なチャンクを作成する方法を実習します。これにより、単純なチャンキング方式を超えて、情報の意味や質問者の意図まで反映した高品質なチャンクを生成する能力を養います。これは、複雑な文書を扱う状況でもLLMが最適な回答を出せるようにするための核心的な戦略です。

このセクションでは、RAGシステムの設計と統合を本格的に扱います。前処理、類似度検索とフィルタリング、チャンクの再構成およびプロンプト設計、回答生成と後処理、そしてハルシネーション(Hallucination)のチェックおよび再投入戦略に至るまで、RAGパイプラインの全過程を体系的に扱います。各段階で認知負荷を最小限に抑えつつ、正確な回答生成に集中するためのノウハウを実習とともに習得します。実務環境ですぐに適用可能な実践的な技術と問題解決方法を重点的に提供します。

このセクションでは、コンテキストの負荷とチャンクサイズを状況に合わせて動的に調整する方法を扱います。質問の複雑さの評価、動的チャンクサイズ調整アルゴリズム、適応型要約パラメータの調整、マルチターン対話におけるコンテキスト累積管理、そしてシステムモニタリングとフィードバックループの設計に至るまで、インテリジェントなシステム運用のための自動化および最適化戦略を深く掘り下げて紹介します。これにより、変化するニーズや複雑さに対応しながら、LLMの性能を最大化できるリアルタイム管理能力を身につけることができます。

RAGシステムとチャンク戦略の効果を客観的に評価するための、多様な指標と評価手法を扱います。再現率、正確性、応答遅延、コスト分析、トークン使用効率、ユーザー満足度、そしてA/Bテストを通じた戦略の検証に至るまで、システム性能の多角的な測定を通じて改善点を導き出す方法を学習します。評価結果に基づいた継続的な性能チューニングと高度化のための知見を提示し、データに基づいた意思決定能力を強化します。

現在、RAGとLLMの認知負荷管理分野で解決すべき研究課題と将来の拡張可能性について議論します。完全自動化されたチャンク最適化、長期記憶の統合問題、大規模マルチメディア文書ベースのRAGシステム構築シナリオ、マルチモーダル情報を処理する方向へのRAGシステムの拡張方法を扱います。最新の研究動向と実際の適用事例を通じて、今後の発展方向と挑戦課題を明確に理解できるようにします。

このセクションでは、これまで学んだ理論と手法を統合し、実際のRAGシステムを設計、実装、調整、評価する総合プロジェクトの遂行方法について説明します。プロジェクトのテーマ選定からデータの収集・前処理、チャンク戦略の設計、RAGシステムの統合、性能評価および結果報告書の作成、最終発表とコードレビューに至るまでの全段階を順を追って進め、実戦能力を検証できるようにします。ここで学んだ内容をもとに、開発者はチームを構成したり個人単位で実務型のプロジェクトを進行したりすることができ、それを通じて本講義で学習した内容を完全に定着させることができるでしょう。

認知負荷の概念に基づき、LLMのコンテキストウィンドウとトークン制限を明確に理解し、これらを管理する戦略を習得します。

様々なチャンク生成技法とチャンク最適化技法により、情報を効率的に分割・要約することで、LLMの性能を最大限に引き出すことができます。

RAGパイプラインの全過程を実習し、実際のシステム構築および調整能力を身につけることができます。

動的な最適化と性能評価を通じて、リアルタイムの運用環境で安定した高性能なAIサービスを提供する方法を学びます。

最新の研究課題と拡張の方向性を通じてAIシステムの発展の流れを理解し、未来への対応力を強化します。

学習対象は

誰でしょう?

LLMとRAGシステムを直接設計または運用する開発者

大容量文書処理およびマルチターン対話処理の最適化に関心がある人工知能エンジニア

前提知識、

必要でしょうか?

自然言語処理(NLP)に関する基本概念の理解

大規模言語モデル(LLM)の基本動作原理の理解

トークン化とコンテキストウィンドウの概念

基本的なプログラミング能力(Python言語推奨)

(任意)人工知能および機械学習モデルを活用した経験や、関連プロジェクトの進行経験

691

受講生

38

受講レビュー

2

回答

4.6

講座評価

18

講座

ITが趣味であり、職業でもある人間です。

執筆、翻訳、アドバイザリー、開発、講義など、多岐にわたる経歴を持っています。

全体

479件 ∙ (46時間 37分)

講座資料(こうぎしりょう):

知識共有者の他の講座を見てみましょう!

同じ分野の他の講座を見てみましょう!