![[VLM101] ファインチューニングでマルチモーダルチャットボットを作る (feat.MCP / RunPod)講義サムネイル](https://cdn.inflearn.com/public/files/courses/337551/cover/01jzjdkw9evbt245h3w2mdfs2r?w=420)

[VLM101] ファインチューニングでマルチモーダルチャットボットを作る (feat.MCP / RunPod)

dreamingbumblebee

¥9,567

初級 / Vision Transformer, transformer, Llama, Model Context Protocol

4.6

(33)

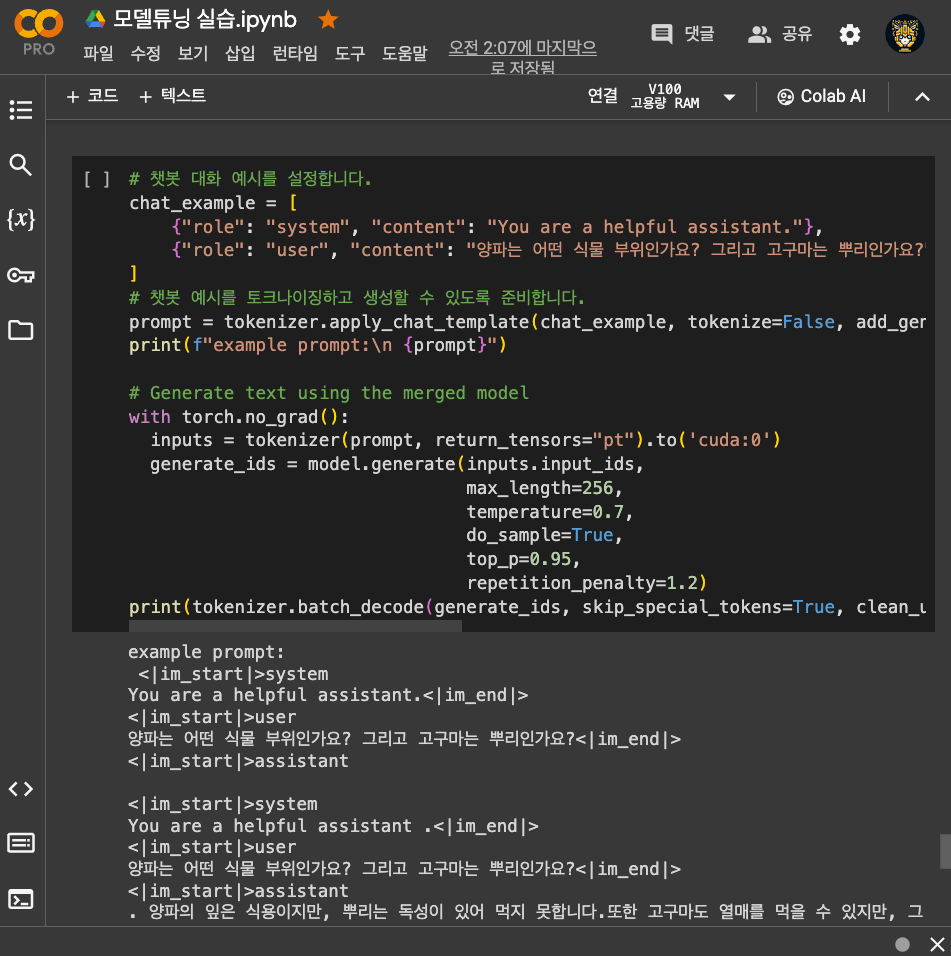

ビジョン言語モデル(Vision-Language Model, VLM)の概念と活用方法を理解し、実際にLLaVAモデルをOllamaベースの環境で実行し、MCP(Model Context Protocol)と連動する過程を実習する入門者向けの講義です。 この講義は、マルチモーダルモデルの原理、量子化(Quantization)、サービス及び統合デモ開発まで扱い、理論と実習をバランスよく提供します。

初級

Vision Transformer, transformer, Llama

![[実践AIoT] スマートミラーメイカソン完璧対策:LLM、CV、ハードウェア設計まで講義サムネイル](https://cdn.inflearn.com/public/files/courses/340196/cover/01kexgfr26whtfsmsqd2dj1x7x?w=420)

![[n8n 業務自動化] 毎日繰り返される業務、3つ自動化するだけで変わります(超初心者編)講義サムネイル](https://cdn.inflearn.com/public/files/courses/340691/cover/01kjtap9pph8a25rvnc1zfq53c?w=420)

![[AIの裏技] 業務爆速化の秘密、Agentic AI講義サムネイル](https://cdn.inflearn.com/public/files/courses/340717/cover/ai/1/3b5cb844-25b5-4576-8224-d293d0989376.png?w=420)

![たった1時間!自分のPCに導入する「自分専用のAI教育係」作り (Antigravity ライブコーディング) [ソースコード提供]講義サムネイル](https://cdn.inflearn.com/public/files/courses/340332/cover/ai/3/e87ee52b-1099-42db-a384-64ab8c725470.png?w=420)