Thống kê học trí tuệ nhân tạo dành cho người không chuyên ngành

arigaram

Thấu hiểu bản chất của thống kê cơ bản cần thiết cho việc phát triển và ứng dụng trí tuệ nhân tạo mà không cần đến một công thức hay một dòng mã nào.

Nhập môn

AI

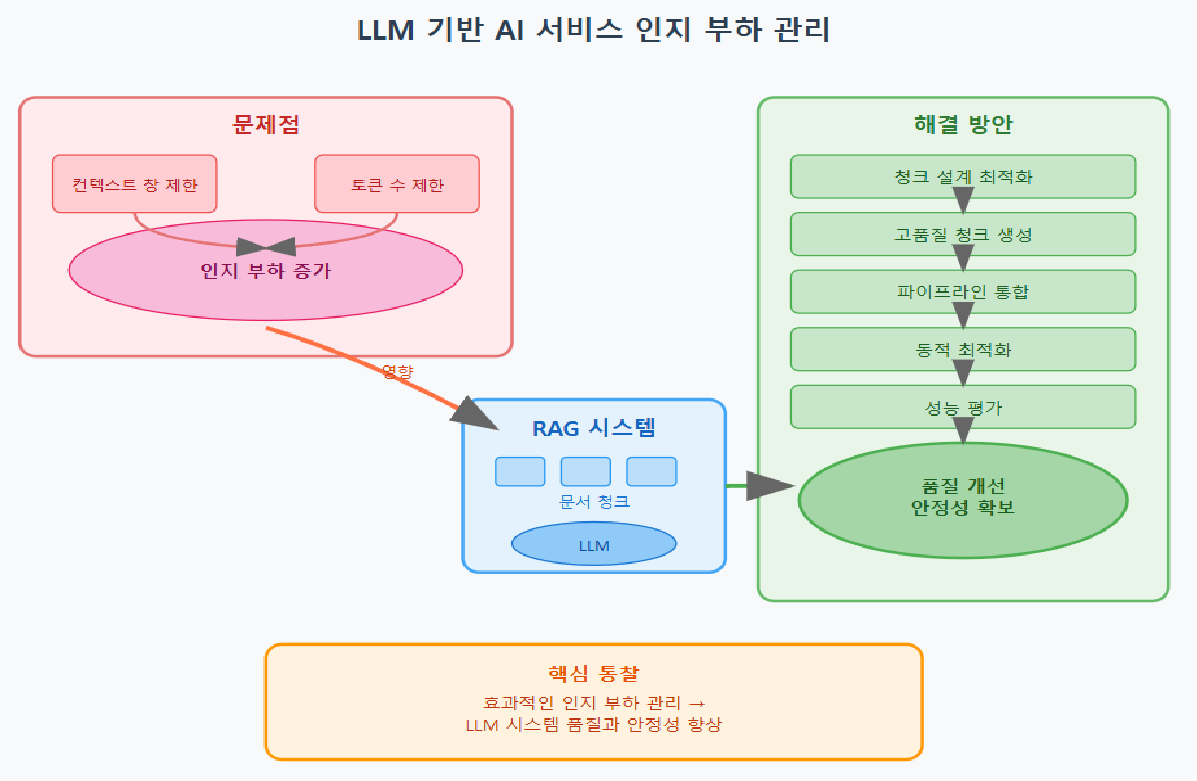

Đề xuất phương án cải thiện hiệu suất RAG dựa trên lý thuyết Tải nhận thức (Cognitive Load). Để vượt qua những hạn chế của các kỹ thuật cải thiện hiệu suất RAG hiện có, chúng tôi tổng hợp các kỹ thuật đa dạng bằng cách áp dụng khung tư duy về tải nhận thức.

23 học viên

Độ khó Trung cấp trở lên

Thời gian Không giới hạn

Chiến lược để hiểu và quản lý giới hạn của cửa sổ ngữ cảnh và token trong LLM

Cách tạo các đoạn dữ liệu (Chunk) chất lượng cao và cách tích hợp chúng vào quy trình RAG (RAG pipeline)

Hiện tại bài giảng đang trong quá trình hoàn thiện. Có một nhược điểm là bạn sẽ phải chờ đợi lâu cho đến khi bài giảng được hoàn tất (mặc dù nội dung sẽ được bổ sung thường xuyên). Vui lòng cân nhắc kỹ điều này trước khi quyết định mua.

Ngày 22 tháng 4 năm 2026

Chúng tôi sẽ tiến hành sửa đổi toàn diện sang phiên bản thứ 2 trong khi phiên bản thứ 1 vẫn chưa hoàn thành. Đối với các phần của phiên bản 1 hiện tại, chúng tôi dự định sẽ xóa bỏ khi các phần tương ứng của phiên bản 2 được hoàn thiện.

Ngày 4 tháng 9 năm 2025

Tôi đã đăng khoảng 2/3 bản tóm tắt tổng hợp cho mỗi phần. Những bản tóm tắt tổng hợp còn lại chưa đăng sẽ sớm được cập nhật từng cái một.

Tôi đã tách Phần 3 thành Phần 3 và Phần 4, nhưng do số phần trong danh sách bài giảng và số phần trong tài liệu học tập không khớp nhau có thể gây nhầm lẫn, nên tôi đã chuyển Phần 4 sang Phần 31 (phần cuối cùng).

Ngày 1 tháng 9 năm 2025

Tôi đã chia Phần 3 thành Phần 3 và Phần 4. Do đó, số thứ tự các phần và số thứ tự trong tài liệu học tập có thể không khớp nhau. Tôi sẽ chỉnh sửa tài liệu và ghi âm lại video để đăng tải lại. Rất mong các bạn thông cảm và chờ đợi.

Chúng tôi đang cấu trúc lại mục lục theo hướng giảm thiểu sự nhầm lẫn cho học viên. Theo đó, các bài học đã tạm thời chuyển sang chế độ riêng tư vào ngày 22 tháng 8 hiện đã được chuyển lại sang chế độ công khai.

Ngày 22 tháng 8 năm 2025

Chúng tôi đã chuyển các bài học thuộc khóa học [Nâng cao] chưa hoàn thiện (Phần 11 ~ 30) sang trạng thái riêng tư. Các bài học này sẽ được công khai theo từng phần hoặc từng bài ngay khi hoàn thành trong tương lai. Đây là biện pháp nhằm giảm thiểu sự nhầm lẫn cho học viên, rất mong các bạn thông cảm.

Việc xây dựng các dịch vụ trí tuệ nhân tạo dựa trên Mô hình ngôn ngữ lớn (LLM) đã trở thành xu hướng chủ đạo, nhưng vẫn tồn tại những hạn chế do kích thước cửa sổ ngữ cảnh và số lượng token bị giới hạn. Đặc biệt, trong hệ thống RAG (Retrieval-Augmented Generation: Thế năng truy xuất phản hồi), nếu không quản lý tốt các tài liệu hoặc các đoạn văn bản (Chunks), sẽ gây ra tình trạng quá tải nhận thức (cognitive load) cho LLM, dẫn đến khó khăn trong việc tạo ra câu trả lời tối ưu.

Tải nhận thức(cognitive load) là mức độ khó khăn trong việc nhận biết thông tin tùy thuộc vào lượng thông tin và độ phức tạp mà hệ thống (bao gồm cả não bộ con người và trí tuệ nhân tạo) phải xử lý. Trong hệ thống LLM, khi tải nhận thức tăng cao, thông tin sẽ bị tích tụ quá mức làm mờ đi các điểm chính, dẫn đến giảm hiệu suất và có thể không đưa ra được câu trả lời ở mức độ mong đợi. Do đó, việc quản lý tải nhận thức hiệu quả là yếu tố then chốt quyết định chất lượng và tính ổn định của các hệ thống dựa trên LLM.

Khóa học này trình bày phương pháp luận từng bước có thể áp dụng trực tiếp vào thực tế, từ thiết kế chunk, tạo chunk chất lượng cao, tích hợp đường ống RAG, đến tối ưu hóa động và đánh giá hiệu suất, dựa trên khái niệm về giới hạn cửa sổ ngữ cảnh của LLM và tải nhận thức. Thông qua đó, chúng tôi kỳ vọng có thể giải quyết đáng kể vấn đề suy giảm chất lượng phản hồi mà các kỹ thuật bổ trợ RAG hiện có không thể xử lý được.

Chiến lược quản lý tải nhận thức theo cửa sổ ngữ cảnh LLM và giới hạn mã thông báo (token)

Cách tạo các đoạn dữ liệu (Chunk) chất lượng cao và phương án sử dụng các kỹ thuật chia nhỏ dữ liệu (Chunking) đa dạng

Kỹ thuật tích hợp tiền xử lý dữ liệu, tìm kiếm, thiết kế prompt và hậu xử lý để xây dựng hệ thống RAG

Điều chỉnh kích thước chunk và tham số tóm tắt trong thời gian thực thông qua tối ưu hóa động

Áp dụng các chỉ số đánh giá hiệu suất và phương án lập báo cáo kết quả

Trí tuệ nhân tạo (AI), ChatGPT, LLM, RAG, Ứng dụng AI (AX)

Trong phần đầu tiên, chúng tôi sẽ làm rõ tổng quan và mục tiêu chung của khóa học này, đồng thời đề cập đến các khái niệm cơ bản về cửa sổ ngữ cảnh (context window) của LLM và quản lý tải nhận thức. Đặc biệt, bạn sẽ được tìm hiểu chi tiết tải nhận thức là gì, tại sao nó lại quan trọng trong môi trường LLM và học các kiến thức cơ bản về RAG. Dựa trên lý thuyết, chúng tôi sẽ điểm qua các chủ đề cốt lõi sẽ được đề cập trong bài giảng, giúp bạn định hướng lộ trình học tập. Các khái niệm được giải thích từng bước một để ngay cả những người mới bắt đầu cũng có thể dễ dàng theo kịp, tạo nền tảng vững chắc để chuyển tiếp tự nhiên sang các chủ đề nâng cao sau này.

Trong phần này, chúng ta sẽ phân tích chuyên sâu về cửa sổ ngữ cảnh (context window) và cơ chế mã hóa token (tokenization) của LLM. Chúng ta sẽ tìm hiểu chi tiết token là gì, chúng được phân chia như thế nào và ảnh hưởng ra sao đến đầu vào của mô hình, đồng thời giải thích thông qua nhiều ví dụ khác nhau về việc giới hạn kích thước cửa sổ ngữ cảnh tác động đến hiệu suất mô hình như thế nào. Ngoài ra, bạn sẽ được học cách tính toán chi phí dựa trên token để rèn luyện kỹ năng thực tiễn, có thể áp dụng khi thiết kế hệ thống thực tế. Thông qua quá trình này, dựa trên sự hiểu biết có hệ thống về token và ngữ cảnh, bạn sẽ nắm bắt một cách trực quan các vấn đề cụ thể trong việc quản lý tải nhận thức.

Thiết kế chunk hiệu quả là cốt lõi của chất lượng hệ thống RAG. Phần này sẽ giới thiệu các chiến lược chia nhỏ dữ liệu (chunking) đa dạng, từ kích thước cố định, dựa trên đoạn văn, gom cụm theo đơn vị ý nghĩa cho đến cấu trúc phân cấp, đồng thời đi sâu vào ưu nhược điểm và các trường hợp áp dụng của từng phương pháp. Dựa trên sự hiểu biết về ảnh hưởng của kích thước và cấu trúc chunk đối với tải nhận thức và việc tận dụng ngữ cảnh, bạn có thể tiếp thu các bí quyết thực tiễn để thiết kế chiến lược chunk tối ưu phù hợp với từng tình huống. Cuối cùng, thông qua các bài thực hành, bạn sẽ được tích lũy kinh nghiệm áp dụng nhiều phương thức chunk khác nhau để kết nối lý thuyết và thực tiễn một cách có hệ thống.

Trong phần này, chúng ta sẽ tìm hiểu các kỹ thuật nâng cao để tạo ra các chunk (đoạn dữ liệu) phù hợp nhằm giảm tải nhận thức và nâng cao chất lượng thông tin. Bạn sẽ được làm quen với nhiều kỹ thuật khác nhau như tóm tắt thông minh, hợp nhất văn bản gốc và văn bản tóm tắt, phân cụm dựa trên embedding, gắn thẻ meta (meta tagging) và phản ánh ý định truy vấn, đồng thời thực hành cách kết hợp các kỹ thuật này để tạo ra các chunk hiệu quả hơn. Thông qua đó, bạn sẽ phát triển năng lực tạo ra các chunk chất lượng cao, vượt xa các phương pháp chia nhỏ đơn thuần để phản ánh được cả ý nghĩa của thông tin và ý định của người đặt câu hỏi. Đây là chiến lược cốt lõi giúp LLM đưa ra câu trả lời tối ưu ngay cả khi phải xử lý các tài liệu phức tạp.

Phần này sẽ đi sâu vào việc thiết kế và tích hợp hệ thống RAG. Chúng tôi sẽ trình bày một cách hệ thống toàn bộ quy trình của RAG pipeline, từ tiền xử lý, tìm kiếm tương đồng và lọc, tái cấu trúc chunk và thiết kế prompt, đến tạo câu trả lời và hậu xử lý, cũng như kiểm tra hiện tượng ảo giác (Hallucination) và chiến lược tái nhập dữ liệu. Bạn sẽ được học các bí quyết tập trung vào việc tạo câu trả lời chính xác trong khi vẫn giảm thiểu tải nhận thức qua từng bước kết hợp với thực hành. Nội dung trọng tâm cung cấp các kỹ thuật thực tiễn và phương pháp giải quyết vấn đề có thể áp dụng ngay vào môi trường làm việc thực tế.

Trong phần này, chúng ta sẽ tìm hiểu cách điều chỉnh linh hoạt tải trọng ngữ cảnh và kích thước chunk phù hợp với từng tình huống. Chúng tôi sẽ giới thiệu chuyên sâu các chiến lược tự động hóa và tối ưu hóa để vận hành hệ thống thông minh, từ đánh giá độ phức tạp của câu hỏi, thuật toán điều chỉnh kích thước chunk động, điều chỉnh tham số tóm tắt thích ứng, quản lý tích lũy ngữ cảnh trong hội thoại đa lượt, cho đến thiết kế vòng lặp phản hồi và giám sát hệ thống. Thông qua đó, bạn sẽ trang bị được khả năng quản lý thời gian thực để tối đa hóa hiệu suất LLM, đồng thời đáp ứng các yêu cầu và độ phức tạp luôn thay đổi.

Phần này đề cập đến các chỉ số và phương pháp đánh giá đa dạng để đánh giá khách quan hiệu quả của hệ thống RAG và chiến lược phân đoạn (chunking). Bạn sẽ học cách rút ra các điểm cần cải thiện thông qua việc đo lường hiệu suất hệ thống trên nhiều phương diện, từ tỷ lệ thu hồi (recall), độ chính xác, độ trễ phản hồi, phân tích chi phí, hiệu quả sử dụng token, mức độ hài lòng của người dùng, cho đến việc kiểm chứng chiến lược thông qua kiểm thử A/B. Dựa trên kết quả đánh giá, phần này sẽ đưa ra những hiểu biết sâu sắc để liên tục tinh chỉnh và nâng cao hiệu suất, đồng thời tăng cường năng lực ra quyết định dựa trên dữ liệu.

Thảo luận về các nhiệm vụ nghiên cứu cần giải quyết và khả năng mở rộng trong tương lai trong lĩnh vực quản lý tải nhận thức RAG và LLM. Nội dung bao gồm tối ưu hóa chunk hoàn toàn tự động, vấn đề tích hợp trí nhớ dài hạn, kịch bản xây dựng hệ thống RAG dựa trên tài liệu đa phương tiện quy mô lớn và phương pháp mở rộng hệ thống RAG theo hướng xử lý thông tin đa phương thức (multimodal). Thông qua các xu hướng nghiên cứu mới nhất và các trường hợp ứng dụng thực tế, người học sẽ hiểu rõ hướng phát triển và những thách thức trong tương lai.

Trong phần này, chúng tôi sẽ hướng dẫn cách thực hiện một dự án tổng hợp nhằm thiết kế, triển khai, điều chỉnh và đánh giá hệ thống RAG thực tế bằng cách tích hợp các lý thuyết và kỹ thuật đã học cho đến nay. Bạn sẽ có thể kiểm chứng năng lực thực tiễn của mình thông qua việc thực hiện tuần tự tất cả các bước: từ lựa chọn chủ đề dự án, thu thập và tiền xử lý dữ liệu, thiết kế chiến lược Chunk, tích hợp hệ thống RAG, đánh giá hiệu suất và viết báo cáo kết quả, cho đến thuyết trình cuối cùng và review mã nguồn. Dựa trên những nội dung đã học tại đây, các nhà phát triển có thể thành lập nhóm hoặc thực hiện các dự án thực tế theo đơn vị cá nhân, từ đó có thể lĩnh hội hoàn toàn những nội dung đã học trong khóa học này.

Dựa trên khái niệm về tải nhận thức, bạn sẽ hiểu rõ về cửa sổ ngữ cảnh và giới hạn token của LLM, từ đó nắm vững các chiến lược để quản lý chúng.

Bằng cách sử dụng các kỹ thuật tạo và tối ưu hóa chunk đa dạng, bạn có thể phân chia và tóm tắt thông tin một cách hiệu quả để tối đa hóa hiệu suất của LLM.

Bạn sẽ được thực hành toàn bộ quy trình RAG pipeline, từ đó trang bị khả năng xây dựng và điều chỉnh hệ thống thực tế.

Thông qua tối ưu hóa động và đánh giá hiệu suất, bạn sẽ học cách cung cấp các dịch vụ AI ổn định và hiệu suất cao trong môi trường vận hành thực tế.

Thông qua các đề tài nghiên cứu mới nhất và hướng mở rộng, người học sẽ hiểu được xu hướng phát triển của hệ thống AI và tăng cường khả năng ứng phó trong tương lai.

Khóa học này dành cho ai?

Nhà phát triển trực tiếp thiết kế hoặc vận hành hệ thống LLM và RAG

Kỹ sư trí tuệ nhân tạo quan tâm đến việc tối ưu hóa xử lý tài liệu dung lượng lớn và xử lý hội thoại đa lượt (multi-turn).

Cần biết trước khi bắt đầu?

Hiểu các khái niệm cơ bản về xử lý ngôn ngữ tự nhiên (NLP)

Hiểu nguyên lý hoạt động cơ bản của Mô hình ngôn ngữ lớn (LLM)

Khái niệm về Tokenization và Cửa sổ ngữ cảnh (Context Window)

Khả năng lập trình cơ bản (khuyến khích ngôn ngữ Python)

(Tùy chọn) Kinh nghiệm sử dụng các mô hình trí tuệ nhân tạo và học máy hoặc kinh nghiệm thực hiện các dự án liên quan

698

Học viên

38

Đánh giá

2

Trả lời

4.6

Xếp hạng

18

Các khóa học

Tôi là một người coi IT vừa là sở thích vừa là nghề nghiệp.

Tôi có nhiều kinh nghiệm trong việc viết lách, dịch thuật, tư vấn, phát triển và giảng dạy.

Tất cả

477 bài giảng ∙ (46giờ 37phút)

Tài liệu khóa học:

Hãy khám phá các khóa học khác của giảng viên!

Khám phá các khóa học khác trong cùng lĩnh vực!