Mặc dù chuyên ngành chính là kỹ thuật cơ khí, nhưng sau khi tốt nghiệp, tôi đã luôn làm công việc đọc và viết mã nguồn. Tôi là Google AI/Cloud GDE và Microsoft AI MVP. Tôi đang vận hành blog TensorFlow (tensorflow.blog), đồng thời viết và dịch các cuốn sách về học máy và học sâu, khám phá ranh giới giữa phần mềm và khoa học một cách đầy thú vị.

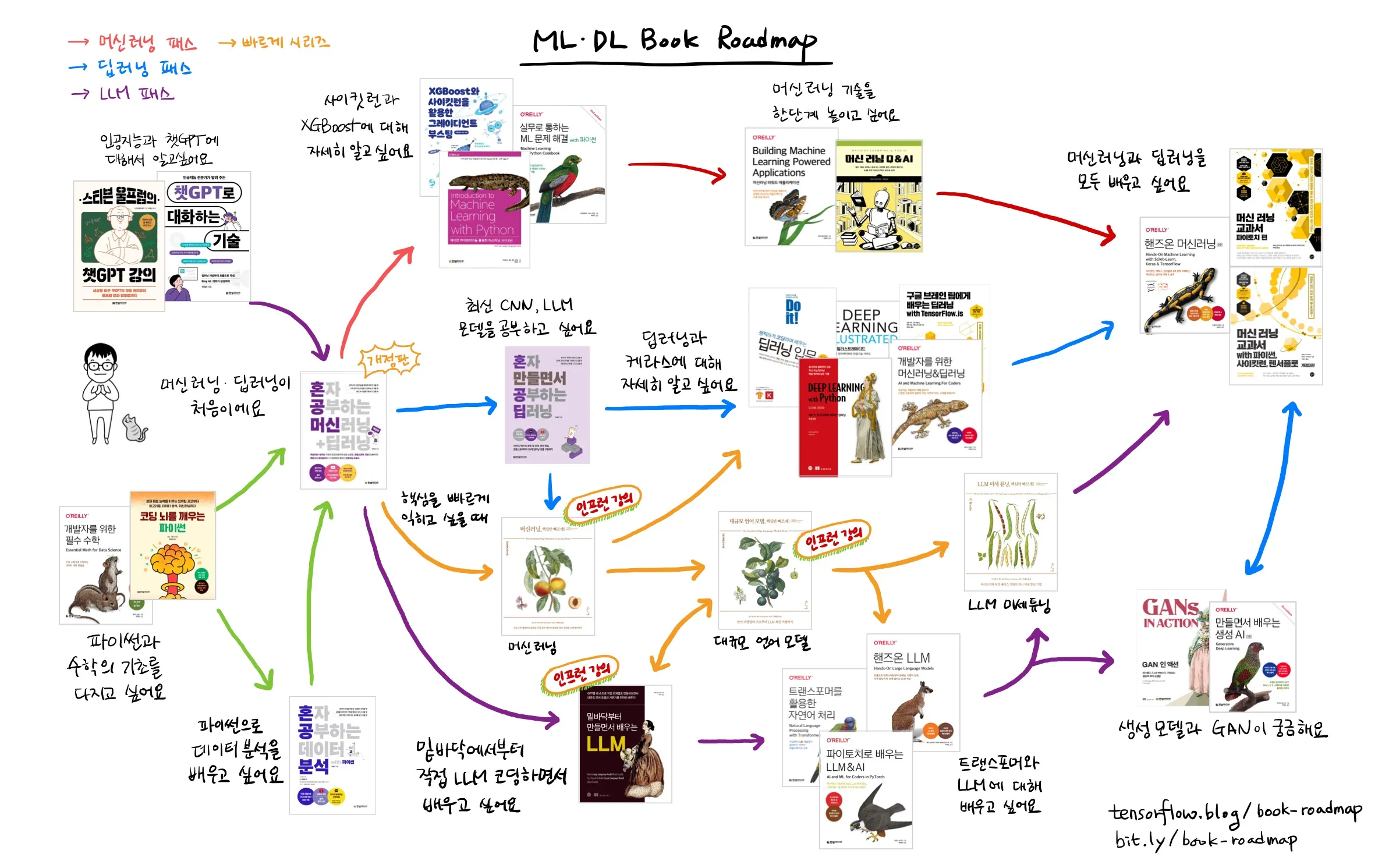

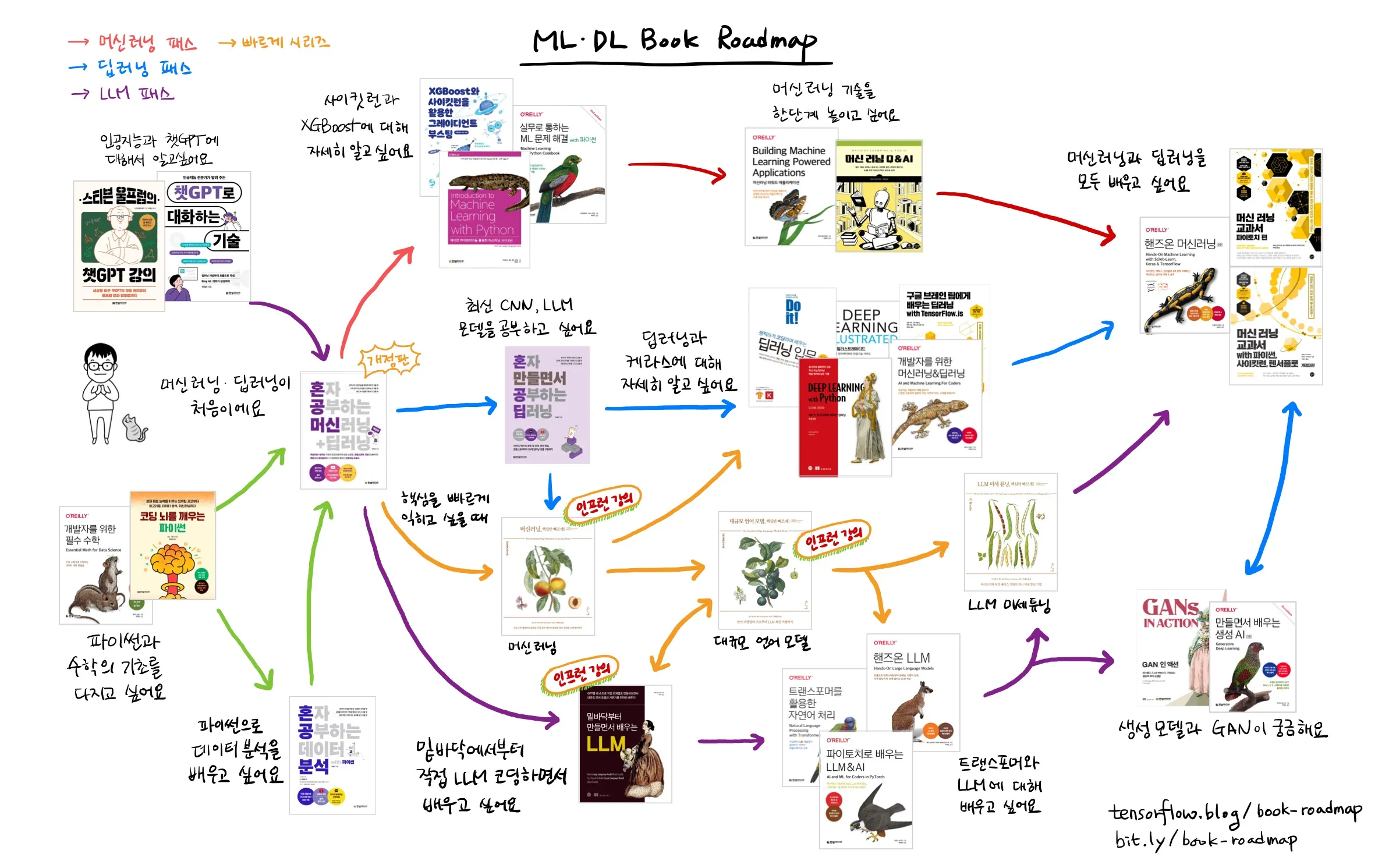

Tôi đã viết các cuốn sách 『Deep Learning tự học qua thực hành』(Hanbit Media, 2025), 『Học máy + Deep Learning tự học (Bản sửa đổi)』(Hanbit Media, 2025), 『Phân tích dữ liệu tự học với Python』(Hanbit Media, 2023), 『Kỹ thuật trò chuyện với ChatGPT』(Hanbit Media, 2023) và 『Do it! Nhập môn Deep Learning』(Easys Publishing, 2019).

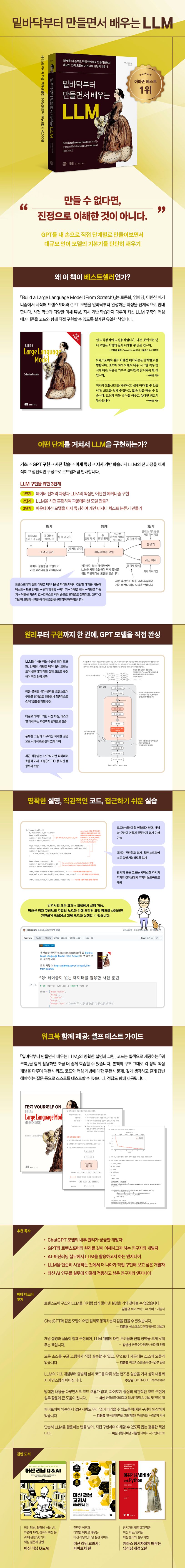

Ông đã dịch hàng chục cuốn sách sang tiếng Hàn, bao gồm các cuốn 『Tinh chỉnh LLM, Nhanh chóng nắm bắt cốt lõi!』 (Insight, 2026), 『Học LLM & AI bằng PyTorch』 (Hanbit Media, 2026), 『Mô hình ngôn ngữ lớn, Nhanh chóng nắm bắt cốt lõi!』 (Insight, 2025), 『Máy học, Nhanh chóng nắm bắt cốt lõi!』 (Insight, 2025), 『Học LLM thông qua việc xây dựng từ con số 0』 (Gilbut, 2025), 『Hands-On LLM』 (Hanbit Media, 2025), 『Machine Learning Q & AI』 (Gilbut, 2025), 『Toán học dành cho nhà phát triển』 (Hanbit Media, 2024), 『Giải quyết vấn đề ML trong thực tế với Python』 (Hanbit Media, 2024), 『Sách giáo khoa Máy học: Phần PyTorch』 (Gilbut, 2023), 『Bài giảng ChatGPT của Stephen Wolfram』 (Hanbit Media, 2023), 『Hands-On Machine Learning Ấn bản thứ 3』 (Hanbit Media, 2023), 『Học Deep Learning tạo sinh thông qua việc xây dựng Ấn bản thứ 2』 (Hanbit Media, 2023), 『Python đánh thức tư duy lập trình』 (Hanbit Media, 2023), 『Xử lý ngôn ngữ tự nhiên với Transformers』 (Hanbit Media, 2022), 『Học Deep Learning từ người sáng tạo Keras Ấn bản thứ 2』 (Gilbut, 2022), 『Máy học & Deep Learning dành cho nhà phát triển』 (Hanbit Media, 2022), 『Gradient Boosting sử dụng XGBoost và Scikit-Learn』 (Hanbit Media, 2022), 『Học Deep Learning từ đội ngũ Google Brain với TensorFlow.js』 (Gilbut, 2022), và 『(Ấn bản sửa đổi thứ 2) Máy học sử dụng thư viện Python』 (Hanbit Media, 2022).