非専門家のための人工知能統計学

arigaram

¥4,354

入門 / AI

数式一つ、コード一行も使わずに、人工知能の開発と活用に必要な基礎統計の本質を突き詰めます。

入門

AI

自然言語処理技術の始まりから最新のLLMモデルに至るまでの過程で開発された、多様な言語モデルについて詳細に説明します。

20名 が受講中です。

難易度 入門

受講期間 無制限

言語モデルの発展過程と各言語モデルの原理

NLPの起源

トランスフォーマーの構造と原理

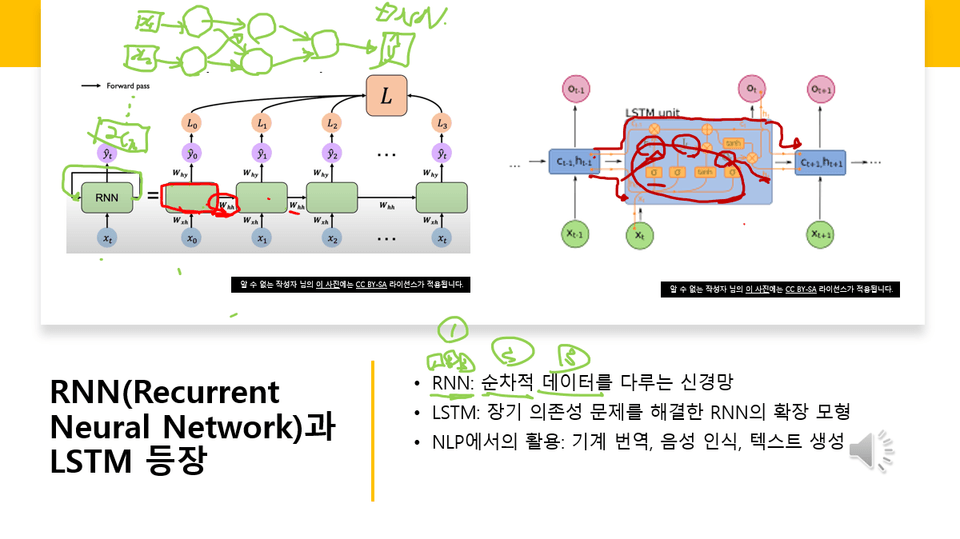

RNN、LSTMの構造と原理

アテンションメカニズムの原理

現在、講義を完成させている途中です。講義がすべて完成するまで(随時補強は行いますが)、長くお待たせしてしまうという欠点があります。これらの点を考慮した上で、購入をご検討ください。

2025年12月10日

新しい授業を大幅に追加する予定で、ひとまず目次を公開しました。[2版]と表記しておきました。

既存の授業を[第1版]であることを表示しておきました。既存の授業を改訂する予定です。改訂された内容に変わる際は、授業のタイトルに[第2版]と表記する予定です。

この講義は、自然言語処理の初期研究から最新の大規模言語モデル(LLM)に至るまで、言語モデルの発展の流れを総合的に学習するコースです。ルールベースの時代から始まり、統計的言語モデル、ニューラルネットワークベースのモデル、トランスフォーマー革命を経て、今日のマルチモーダル・効率化・応用中心のLLMへと続く技術的な変化を体系的に理解します。

言語モデルがどのように発展してきたのか、全体の流れを理解する。

時代別の主要モデル(RNN、LSTM、Transformer、BERT、GPTなど)の特徴を把握する。

最新のLLM技術と研究動向を構造的に整理する。

LLMの効率化技術と実際の応用方式を理解する。

未来のLLM研究の方向性と限界点を批判的に考察する。

講義は計6つのセクションで構成されており、各セクションは時代の流れと研究の軸を中心に構成されています。

セクション 1: NLPの起源と初期の発展

セクション 2: トランスフォーマー以前の言語モデル研究

セクション 3: トランスフォーマー革命と大規模言語モデル

セクション 4: 最新のLLM技術と研究動向

セクション 5: LLM効率化技術とモデル最適化

セクション 6: LLMの応用・システム統合・未来展望

このセクションでは、NLPの出発点から初期言語モデルの基盤について学習します。

NLPがどのような問題を扱い、どのように始まったのか

ルールベースのシステムがどのように構成され、なぜ限界に直面したのか

統計的言語モデル(n-gram LM)がどのように登場したのか

Brown Corpus、Penn Treebankなど初期の大規模コーパスの登場と意義

分布仮説(Distributional Hypothesis)の概念とNLPへの適用方式

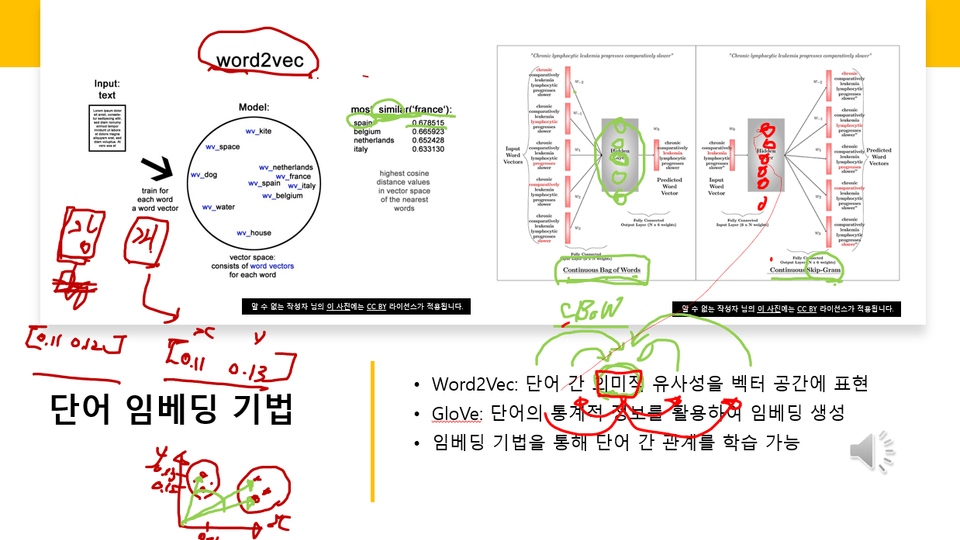

Word2Vec、GloVeなど初期の単語埋め込み技術の誕生と貢献

このセクションでは、RNN系列のモデルがNLPをどのように変化させたのか、そしてトランスフォーマー以前の技術的な限界について扱います。

RNN、LSTM、GRUの登場背景と構成原理

長期依存性問題(Long-term dependency)の本質

Seq2Seq構造が機械翻訳の革新をどのように導いたのか

Attentionメカニズムが登場した理由と効果

CNNベースの言語モデルは研究分類が異なるため不確実ですが、主要なアイデアを学習

トランスフォーマー直前の研究状況を整理し、次世代モデルの必要性を理解

このセクションでは、トランスフォーマー中心の現代LLM時代がどのように切り拓かれたのかについて学びます。

「Attention Is All You Need」に代表されるTransformerの構造・特徴

事前学習(Pretraining)・言語理解モデルの登場背景

BERTモデルの双方向性の概念、MLM(Masked LM)手法

GPTシリーズ(GPT–GPT-4)の主な発展の流れ

「事前学習 → 微調整(ファインチューニング)」の標準化された学習パラダイムの定着

スケーリング則(Scaling Laws)の意味およびLLM訓練戦略の変化

このセクションでは、最新LLMの構造・特徴・学習方式だけでなく、人間からのフィードバックに基づくモデルまでを扱います。

GPT-4、Llama、Claudeなど最新LLMの共通特性

オープンソースLLM(例:Llama・Mistral)の登場背景

RLHF・DPO・Instruction Tuningといったユーザーカスタマイズ型学習技術

マルチモーダル(Multimodal)モデルの構造と活用事例

偏向・ハルシネーション・安全性に関する研究と倫理的考慮要素

このセクションは、大規模モデルをより軽量かつ高速にする技術が中心です。

量子化(Quantization)、プルーニング(Pruning)、知識蒸留(Distillation)

LoRA・Prefix TuningなどのPEFT(Parameter-Efficient Fine-Tuning)

FlashAttentionなどの高速Attentionアルゴリズム

推論コスト削減手法

オンデバイス(on-device)LLMの概念と技術的課題

実際のサービス適用における効率化事例

このセクションでは、LLMが実際のシステム・サービスでどのように活用されているかを学び、

将来の方向性については一部の不確実性を認めつつ整理します。

Retrieval-Augmented Generation(RAG)の構造と利点

Toolformer・ReActなどツール利用ベースのLLMの原理

医療・法律・コーディングのようなドメイン特化型LLM

GPT-4Vなどマルチモーダルモデルの拡張

LLMベースの自律システム研究(一部「不確実」)

LLMの未来展望および論争点(例:AGIの可能性 → 「不確実」)

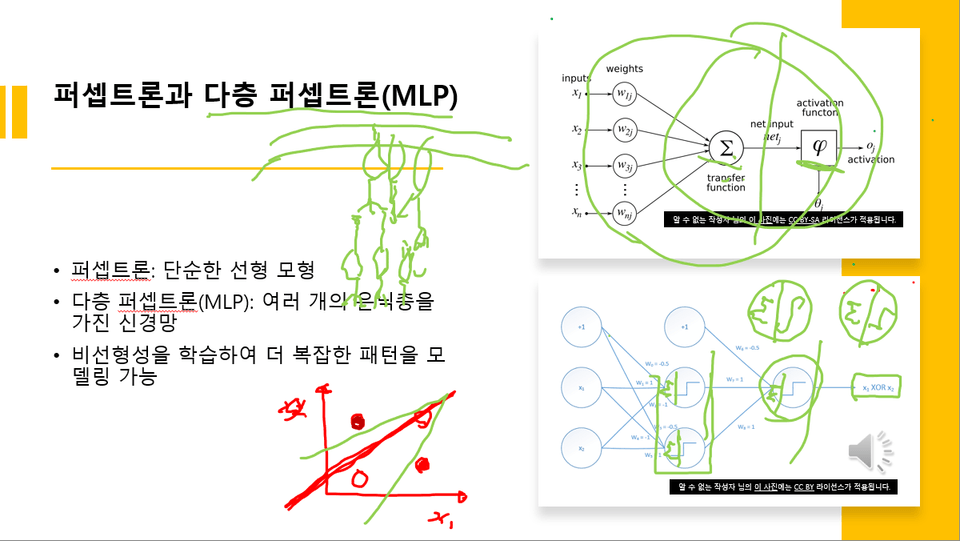

下の例示画面のように、講義中に各種図式を使用してLLMに関連する概念を詳しく説明します。 特にNLP、RNN、self-attention、transformer、LLMに関連する図式を使用して集中的に説明します。

レッスン3で説明する画面例1

授業3で説明する画面例2

講義タイトル

授業3で説明する画面例3

人工知能・データサイエンスに関心のある学習者

NLPまたはLLM技術を体系的に理解したい開発者・研究者

人工知能技術の最新トレンドを把握したい方

基本的な機械学習の概念

Pythonベースの簡単なモデルの使用経験(推奨)

言語モデルの全体的な発展の歴史を深く理解することができます。

最新のLLM技術とトレンドを分析し、活用するための基礎知識を身につけることができます。

LLMを活用した問題解決・サービス設計・研究の方向性を設計することができます。

理論中心の講義であるため、別途の実習環境は必要ありません。

講義資料をPDFファイル形式で添付します。

LLMの歴史と発展:言語モデルの起源から最新技術まで

学習対象は

誰でしょう?

LLMの起源と発展過程、および技術動向を知りたい方

LLMの基盤となる人工ニューラルネットワークの構造を知りたい方

LLMを直接開発するための理論的知識を身につけたい方

695

受講生

38

受講レビュー

2

回答

4.6

講座評価

18

講座

ITが趣味であり、職業でもある人間です。

執筆、翻訳、アドバイザリー、開発、講義など、多岐にわたる経歴を持っています。

全体

72件 ∙ (10時間 39分)

講座資料(こうぎしりょう):

知識共有者の他の講座を見てみましょう!

同じ分野の他の講座を見てみましょう!

¥41,910