기계가 w를 업데이트를 하는 과정

356

작성한 질문수 19

안녕하세요 선생님

경사하강법,오차역전파, 편미분, 잔차에 대한 개념은 이해를 했으나 궁금한점이 있습니다

기계가 예측오류를 줄이기 위해서 w업데이트를 하는 과정이 잘 이해가가 가지 않습니다

예를 들어 가중치들이 초기값 으로 시작했고 나온 출력값과 실제값의 차이가 크면 가중치계수를 줄이고 늘리는 방식이 어떤 과정을 통해서 되는지 아직 잘 이해가 가지 않는데 조금 만 더 쉽게 설명해주실수 있나요?

예) w0 = 1, w1 = 5 - > y_hat = 10이고 y = 15이면 5만 큼의 차이가 발생했는데 여기서 5를 줄이기 위해서 어떻게 w가 업데이트 되는지 이해가 가지 않습니다

답변 2

0

안녕하세요 선생님

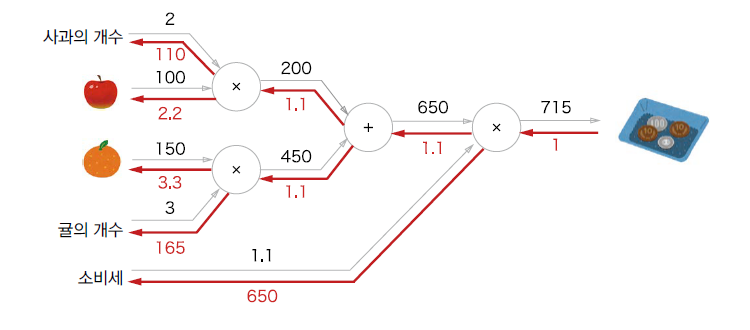

체인룰 설명에서 선생님이 설명해주신 것 처럼 편미분을 통해서 왼쪽긑에 110, 2.2, 3.3, 165, 650을 도출하는데 이 값들이 잔차의 값이 작아지도록 바뀌어지는 건가요?

체인룰 설명에서 선생님이 설명해주신 것 처럼 편미분을 통해서 왼쪽긑에 110, 2.2, 3.3, 165, 650을 도출하는데 이 값들이 잔차의 값이 작아지도록 바뀌어지는 건가요?

0

안녕하십니까,

음, 지금 강의는 손실함수에 대한건데, 질문으로 봐서는 경사하강법에 대해서 다시 한번 강의 영상을 보시면 어떨까 싶습니다.

강의에서 질문하신 내용에 대해서 여러개의 영상에 걸쳐서 설명드리고 있는데, 포괄적인 내용으로 질문을 하셔서 제가 답변드리기가 현재는 어렵군요.

앞에 말씀드린 대로 w에 대한 update부분은 경사하강법은 다시 참조해 주시고, 그래도 강의 내용이 이해가 안되시면 강의 내용의 어느 부분이(어떤 강의의 몇분 몇초 영상) 이해가 안되시는지 좀 더 자세하게 적어주셨으면 합니다.

감사합니다.

resize 질문

0

50

1

20251212 Kaggle 런타임에 scikit-learn 설치 실패 트러블 슈팅

0

75

1

Loss와 매트릭 관계

0

61

2

Boston 코랩 실습

0

162

2

배치 정규화의 이해와 적용 2 강의 질문

0

134

2

Augmentation원본에 적용해서 데이터 갯수 자체를 늘리는 행위는 의미가있나요?

0

144

2

Conv함수 안에 activation 을 넣지 않는 이유가 뭔지 궁금합니다.

0

203

2

소프트맥스 관련 질문입니다

0

208

1

강의 관련 질문입니다

0

151

2

residual block과 identity block의 차이

0

185

2

옵티마이저와 경사하강법의 차이가 궁금합니다.

1

238

1

실습 환경

0

165

2

입력 이미지 크기

0

243

2

데이터 증강

0

195

2

albumentations ShiftScaleRotate

0

205

1

Model Input Size 관련

0

279

1

마지막에 bird -> frog 말고도 deer -> frog 도 잘못된것 아닌가요??

0

204

1

일반적인 질문 (kaggle notebook사용)

0

272

2

실무에서 Augmentation 적용 시

0

338

2

안녕하세요 교수님

0

231

1

가중치 초기화(Weight Initialization) 질문입니다.

0

327

1

테스트 데이터셋 predict의 'NoneType' object has no attribute 'shape' 오류

0

407

1

학습이 이상하게 됩니다.

2

1036

2

boston import가 안됩니다

0

228

1