すぐ使えるバイブコーディング – 運営費用0円

Dewey Hong

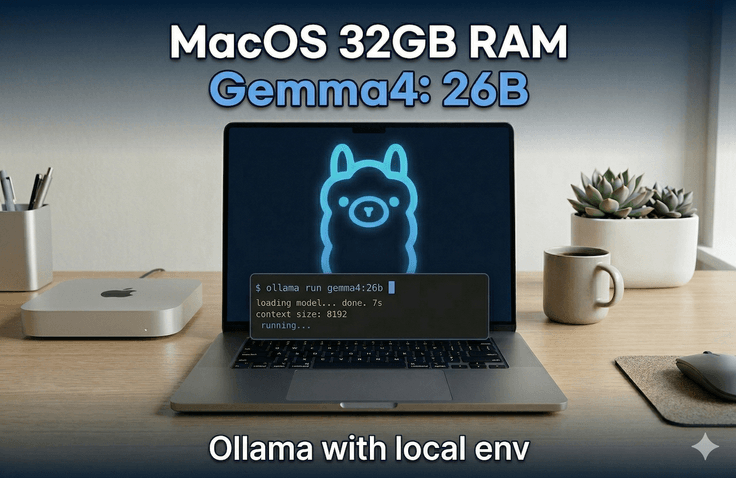

シリコンバレーでの実務経験に基づいたDevOps講座です。理論だけでなく、実務ですぐに活用できる内容を扱います。生成AI(バイブコーディング)による開発、Kubernetes環境でのCI/CDツールの設定、そして運用コストを0円に抑える戦略について解説します。DB、Redis、S3、バッチジョブをKubernetes内部で運用することで、追加費用なしでプロダクション環境を構築し、GitHub WebhookとJenkinsを活用した自動化パイプラインの構築方法を実習プロジェクトを通じて習得します。

初級

Kubernetes, CI/CD, cursor

![[一言でパパッと!] AIと一緒に自分だけの収益化ウェブサイトを作る方法講義サムネイル](https://cdn.inflearn.com/public/files/courses/336091/cover/01jxykkyatyya1dnv22ctkvtwe?w=420)

![[インフラーンアワードベストセラー] コーディングなしでAI自動化エキスパートになる方法、n8n完全ガイド講義サムネイル](https://cdn.inflearn.com/public/files/courses/337053/cover/01jrkjt8emye2z7j7846br3vkk?w=420)

![[AI実習] Prompt-to-prompt論文実装を通じて理解するDiffusionモデル講義サムネイル](https://cdn.inflearn.com/public/files/courses/339089/cover/01k7chg2b60npdvpaykrypzmk7?w=420)

![[実践AIoT] スマートミラーメイカソン完璧対策:LLM、CV、ハードウェア設計まで講義サムネイル](https://cdn.inflearn.com/public/files/courses/340196/cover/01kexgfr26whtfsmsqd2dj1x7x?w=420)