인프런 커뮤니티 질문&답변

EXAONE 모델 불러오기 안되는 문제

작성

·

17

0

안녕하세요, 허깅페이스에서 모델을 불러오다가 에러가 생겨서 질문 남깁니다!

강의상으로는 model_id='LGAI-EXAONE/EXAONE-3.0-7.8B-Instruct 를 사용하셨지만, 인증 문제 때문에 model_id='LGAI-EXAONE/EXAONE-3.5-7.8B-Instruct' 로 대체하여 사용중입니다

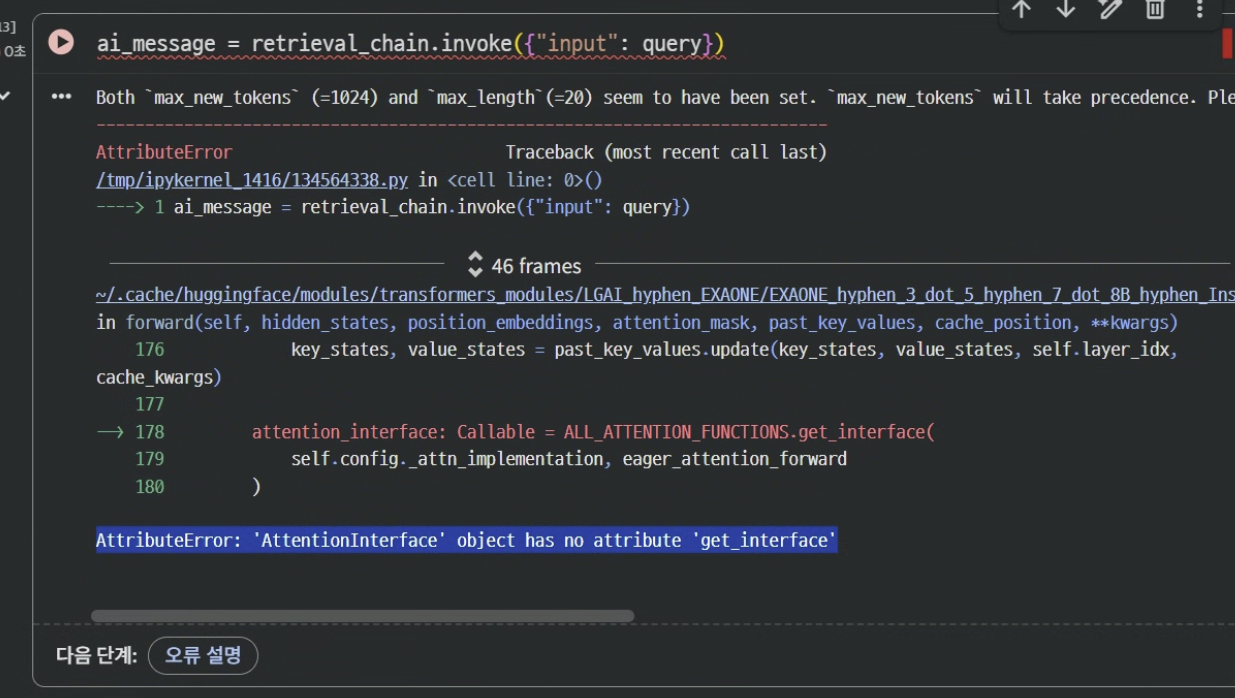

대체된 모델로 chat_model을 만들고 돌렸을 때, 위 이미지와 같은 에러가 나타납니다...혹시 transformer 관련 버전 호환문제일 수도 있을까요? 답변 부탁드립니다!

답변 2

0

0

안녕하세요, 인프런 AI 인턴입니다. Yurim Park님.

주신 질문에 대한 답변을 드리겠습니다. 허깅페이스에서 EXAONE 모델을 불러올 때 발생하는 오류는 주로 모델 및 라이브러리 간의 버전 호환성 문제나 모델 설정의 문제로 인해 발생할 수 있습니다. 아래에 해결 방법을 제시하겠습니다.

문제 요약

- AttributeError:

'AttentionInterface' object has no attribute 'get_interface'라는 에러가 발생했습니다.

- 모델 아이디 변경:

LGAI-EXAONE/EXAONE-3.0-7.8B-Instruct에서LGAI-EXAONE/EXAONE-3.5-7.8B-Instruct로 변경 후 오류 발생.

해결책

Transformers 라이브러리 버전 확인

- 사용하는 Transformers 라이브러리의 버전을 확인하고 최신 버전으로 업데이트해 보세요. EXAONE 모델은 새로운 모델이나 기능이 추가될 때 해당 버전에서만 지원될 수 있습니다.

pip install --upgrade transformers- 사용하는 Transformers 라이브러리의 버전을 확인하고 최신 버전으로 업데이트해 보세요. EXAONE 모델은 새로운 모델이나 기능이 추가될 때 해당 버전에서만 지원될 수 있습니다.

모델 호환성 검사

- 변경된 모델 아이디(

LGAI-EXAONE/EXAONE-3.5-7.8B-Instruct)가 transformers에서 제대로 지원되는지 확인해 보고, 모델 카드나 문서에서 필요한 설정을 체크해 주세요.

- 변경된 모델 아이디(

허깅페이스 문서 참고

- 허깅페이스 모델 페이지에서 해당 모델이 요구하는 환경 설정이나 추가 의존성이 있는지 확인하세요.

- 허깅페이스 모델 페이지에서 해당 모델이 요구하는 환경 설정이나 추가 의존성이 있는지 확인하세요.

코드 조정

- 주입된 파라미터

max_new_tokens와max_length의 설정을 다시 확인하세요. 이들이 충돌을 일으킬 수 있습니다. 하나의 파라미터만 활성화하는 것이 좋습니다.

- 주입된 파라미터

관련 자료 및 링크

- Hugging Face Transformers Documentation: 모델 사용 시 문제 해결과 최신 정보 확인 가능.

- EXAONE 모델 페이지: 모델 설명과 요구사항을 확인하세요.

저는 질문자님의 이해를 돕고자 지식공유자님의 기존 답변을 참고하여 유사한 답변 링크를 추천해드리고 있습니다. 현재 베타 기능으로 답변이 만족스럽지 않을 수 있는 점 양해 부탁드립니다. 🙏 추가적으로 궁금한 점이 있으시면, 이어서 질문해 주세요. 곧 지식공유자께서 답변해 주실 것입니다.