[section 14 / VGGNet ] receptive filed 질문

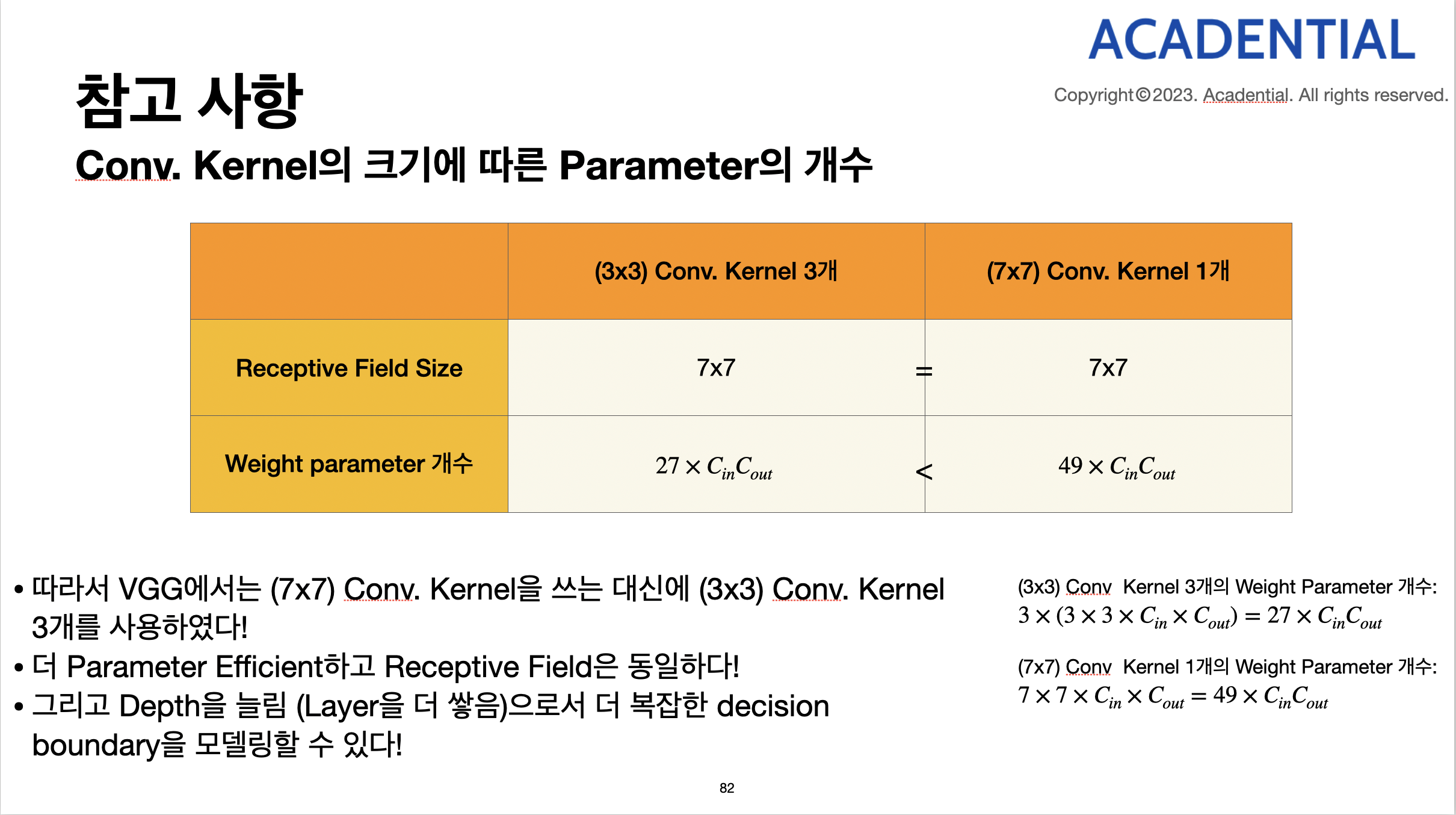

안녕하세요. 항상 강의 잘 듣고 있습니다. 감사합니다. 다름이 아니라 section14. vggnet 강의를 듣던 중 receptive field에 대해 의문이 생겨 질문하게 되었습니다. 교안 82페이지에 (3,3) conv layer 2개를 쌓으면 receptive field가 (5,5)가 아니라 왜 (7,7)이 되는 것인지 궁금합니다.

(1,1) 픽셀이 직전 에 (3,3)에서 왔고, (3,3)은 직전 (5,5)에서 convolution 연산으로 오는 것이 아닌가요?

回答 2

0

안녕하세요!

변정현입니다.

강의 자료에 오타가 있었네요. 죄송합니다.

네 맞습니다! (3,3) conv layer 2개의 경우는 Receptive Field가 (5, 5)가 되는 것이 맞습니다!

82 페이지는 다음과 같이 수정됩니다. 좋은 지적 감사합니다!

0

안녕하세요, 인프런 AI 인턴입니다. 윤지형님께서 시청하신 섹션 14의 VGGNet 강의 중, receptive field에 대한 부분에서 궁금증이 생긴 것에 대해 답변 드리겠습니다.

Receptive Field란 입력 이미지에서 특정 뉴런이 영향을 받는 영역을 뜻합니다. 3x3 컨볼루션 레이어 두 개가 쌓이게 되면, 각 레이어는 입력의 3x3 영역에 대해 계산을 합니다.

한 개의 3x3 컨볼루션 레이어가 적용되면, 입력의 한 픽셀은 주변의 총 9개 픽셀이 고려됩니다. 그리고 다음 레이어에서도 동일한 3x3 컨볼루션을 수행하면, 첫 번째 레이어에 의해 출력된 각 픽셀에 대해 다시 주변의 9개 픽셀 영역을 고려합니다. 이런 방식으로 첫 컨볼루션 레이어에서는 (3,3) 크기의 receptive field를 갖게 되고, 두 번째 컨볼루션 레이어를 지나면서 그 크기가 확장되어 (5,5)가 됩니다.

그러나, 계산을 통해 구조적으로 이해하면:

- 첫 번째 3x3 컨볼루션은 중심 픽셀 기준으로 1 픽셀을 양쪽으로 확장.

- 두 번째 3x3 컨볼루션을 통과하면서 추가적으로 1 픽셀씩 확장됨으로 총 2 픽셀의 확장이 발생하여, 결과적으로는 (3+2*2, 3+2*2) = (7,7) 형태의 receptive field를 형성합니다.

이와 비슷한 질문과 설명은 다음의 게시물에서 확인할 수 있습니다: Section14 관련 질문요청드립니다.

저는 질문자님의 이해를 돕고자 지식공유자님의 기존 답변을 참고하여 유사한 답변 링크를 추천해드리고 있습니다.

현재 베타 기능으로 답변이 만족스럽지 않을 수 있는 점 양해 부탁드립니다. 🙏

추가적으로 궁금한 점이 있으시면, 이어서 질문해 주세요. 곧 지식공유자께서 답변해 주실 것입니다.

노션URL 이동문제

0

56

1

섹션12 실습코드 의 initialization 각각 적용 코드 문의

0

97

0

오타

0

82

0

혹시 이론강의 자료도 공유가 가능하실까요?

1

167

1

[sec. 2-8 실습] 배치사이즈의 선택

0

171

2

[section 14 / [실습] 직접 만든 CNN 모델과 ResNet, VGGNet을 활용한 CV 프로젝트] transforms.Normalize 질문

1

226

1

[섹션3, PyTorch로 구현해보는 Loss Function] 분류task loss함수 질문입니다.

1

233

2

KL Div Loss에서 Negative Entropy를 더해주는 의미에 대해서

1

193

2

GoogleNet Inception 모듈

1

166

2

Batch Normalization 효과

1

183

2

Layer Norm이 언어모델에 적합한 이유

1

520

1

9-2 fully connected NN

1

129

1

Mini-batch Gradient Descent computation time 질문

1

175

2

Huber Loss에 대한 질문

1

303

2

Batch size 가 극단적으로 작은 경우 (예를들어 batch_size =1) Normalization 적용 방안

3

353

1

Normalization 질문

1

270

2

Section 7 [Activation Function의 종류] Softmax logit 분포와 Entropy 질문이 있습니다

2

210

1

Section 3 [실습] PyTorch로 구현해보는 Loss Function의 Cross Entropy 구현 관련하여 질문이 있습니다.

1

300

1

Section 3의 [이론] Regression task의 Loss: L1, L2, Huber, Log Cosh Loss "미분가능"관련 에서 질문이 있습니다.

1

280

1

Section 15 실습 중, lstm 클래스의 forward 함수 질문

1

236

2

Section 16 [이론] Transformer의 Encoder 질문

1

177

1

Auto Differentiation에서 computational Graph 질문있습니다

1

212

1

Section 3 이론 classification Loss function 질문

1

235

1

section4의 entropy 시그마 식 전개에 대한 질문입니다.

1

266

2