[sec. 2-8 실습] 배치사이즈의 선택

171

投稿した質問数 2

안녕하세요. 좋은 강의 잘 듣고 있습니다. 반복해서 여러 차례 들을 수 있어서 정말 좋습니다.

조금 기초적인 질문인가 싶은데요.

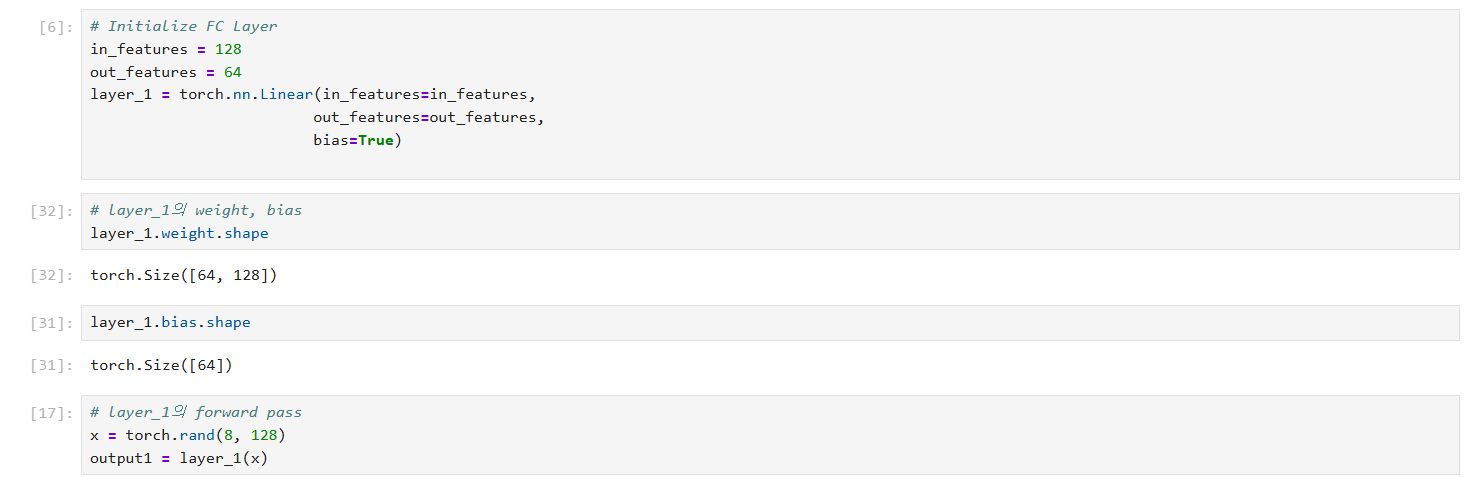

아래 이미지에서 질문이 있습니다.

맨 아래 셀의 코드

x = torch.rand(8, 128)에서 배치 사이즈를 8로 정하는 이유를 질문드립니다.

in feature가 128이고, out feature가 64라서 대략 2의 배수가 선택된 것인가 추측합니다.

다음 시리즈 기다리고 있습니다. 감사합니다.

回答 2

0

안녕하세요, 인프런 AI 인턴입니다.

iklee님, 질문해 주셔서 감사합니다. 딥러닝에서 배치 사이즈는 주로 모델의 학습 성능과 메모리 효율성에 큰 영향을 미치기 때문에 중요한 선택입니다.

배치 사이즈를 8로 정한 이유는 여러 가지가 있을 수 있습니다:

메모리 효율성: 배치 사이즈가 크면 학습에 필요한 메모리가 많이 필요하기 때문에, 메모리 제한에 맞추기 위해 작은 배치 사이즈를 선택할 수 있습니다.

학습 성능: 작은 배치 사이즈는 매 반복마다 더 자주 가중치를 업데이트하여 수렴 속도가 빠르게 됩니다. 하지만 너무 작은 배치 사이즈는 모델이 안정적으로 수렴하지 않을 수 있습니다.

개발 및 테스트 목적: 때로는 빠른 개발 및 테스트를 위해 작은 배치 사이즈를 사용할 수 있습니다.

배치 사이즈가 2의 배수인 이유는 GPU 메모리가 보통 2의 배수로 동작하기 때문입니다. 따라서 연산 효율성을 높이기 위해 2의 배수로 선택하는 것이 일반적입니다.

이유는 다양하지만, 결국 배치 사이즈는 모델, 데이터, 하드웨어 리소스에 따라 최적화되어야 합니다. 마찬가지로 다른 배치 사이즈로 실험하여 성능을 비교해 볼 수 있습니다.

계속해서 좋은 학습 되시기 바랍니다! 다음 시리즈도 많은 기대 부탁드립니다. 감사합니다.

노션URL 이동문제

0

56

1

섹션12 실습코드 의 initialization 각각 적용 코드 문의

0

97

0

오타

0

82

0

혹시 이론강의 자료도 공유가 가능하실까요?

1

167

1

[section 14 / [실습] 직접 만든 CNN 모델과 ResNet, VGGNet을 활용한 CV 프로젝트] transforms.Normalize 질문

1

226

1

[section 14 / VGGNet ] receptive filed 질문

1

131

2

[섹션3, PyTorch로 구현해보는 Loss Function] 분류task loss함수 질문입니다.

1

233

2

KL Div Loss에서 Negative Entropy를 더해주는 의미에 대해서

1

193

2

GoogleNet Inception 모듈

1

166

2

Batch Normalization 효과

1

183

2

Layer Norm이 언어모델에 적합한 이유

1

520

1

9-2 fully connected NN

1

129

1

Mini-batch Gradient Descent computation time 질문

1

175

2

Huber Loss에 대한 질문

1

303

2

Batch size 가 극단적으로 작은 경우 (예를들어 batch_size =1) Normalization 적용 방안

3

353

1

Normalization 질문

1

270

2

Section 7 [Activation Function의 종류] Softmax logit 분포와 Entropy 질문이 있습니다

2

210

1

Section 3 [실습] PyTorch로 구현해보는 Loss Function의 Cross Entropy 구현 관련하여 질문이 있습니다.

1

300

1

Section 3의 [이론] Regression task의 Loss: L1, L2, Huber, Log Cosh Loss "미분가능"관련 에서 질문이 있습니다.

1

280

1

Section 15 실습 중, lstm 클래스의 forward 함수 질문

1

236

2

Section 16 [이론] Transformer의 Encoder 질문

1

177

1

Auto Differentiation에서 computational Graph 질문있습니다

1

212

1

Section 3 이론 classification Loss function 질문

1

235

1

section4의 entropy 시그마 식 전개에 대한 질문입니다.

1

266

2