2-7 병렬 처리를 통한 효율 개선 파트 chain 구축

143

작성한 질문수 5

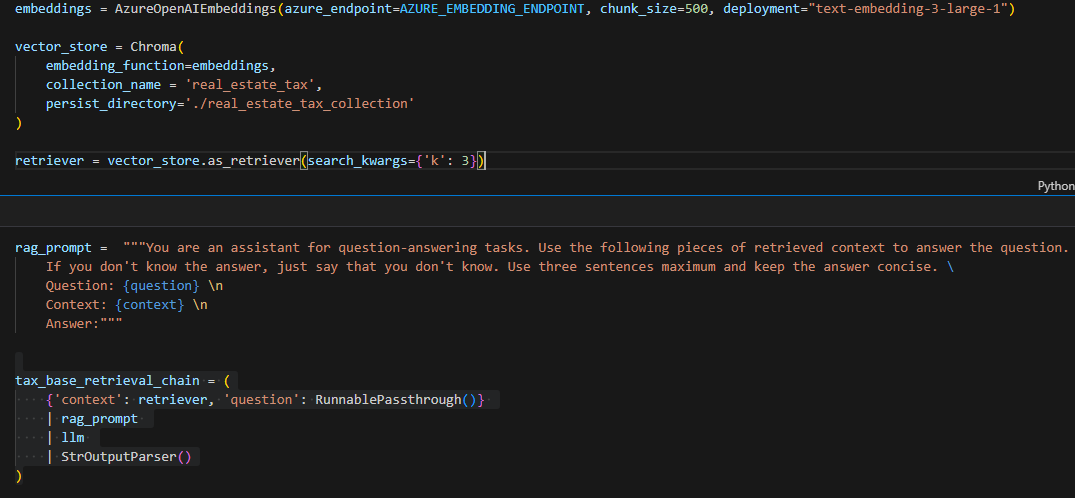

아래 처럼 hub.pull을 사용하면 에러가 발생해서, https://smith.langchain.com/hub/rlm/rag-prompt 해당 링크의 문구를 그대로 사용하고 있는 것 외에는 전부 동일한 코드인데, tax_base_retrieval_chain을 구축할 때 에러가 발생합니다

hub.pull('rlm/rag-prompt')답변 2

0

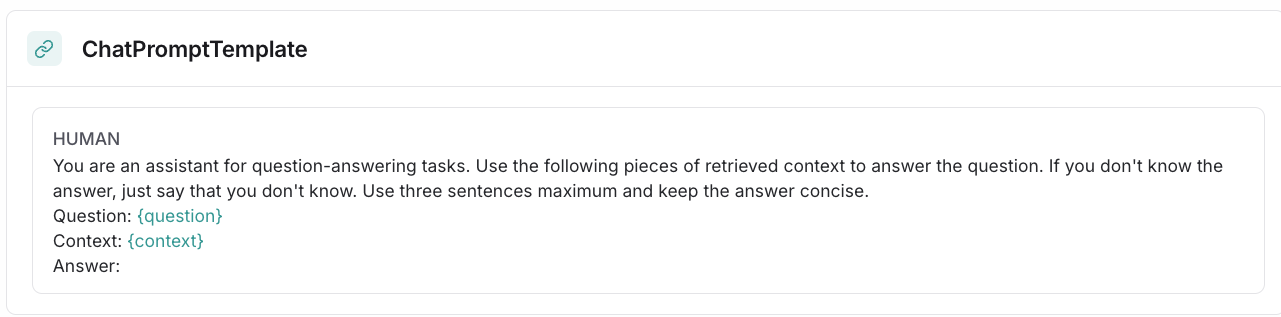

안녕하세요! 그 이유는 hub.pull() 로 가져오는 프롬프트는 string이 아니라 PromptTemplate 이기 때문입니다. 다른 수강생분께서 질문을 주신 적 있어서 답변을 드린 적이 있는데요,

string 처럼 보이지만 ChatPromptTemplate에서 HumanMessage에 해당합니다. 직접 작성하시려면 아래 코드처럼 작성하셔야 합니다

from langchain_core.prompts import ChatPromptTemplate

rag_prompt = ChatPromptTemplate.from_messages([

('human', '''You are an assistant for question-answering tasks. Use the following pieces of retrieved context to answer the question. If you don't know the answer, just say that you don't know. Use three sentences maximum and keep the answer concise.

Question: {question}

Context: {context}

Answer:''')

])

0

안녕하세요, 인프런 AI 인턴입니다. gymoon10님께서 작성하신 질문에 대해 답변드리겠습니다.

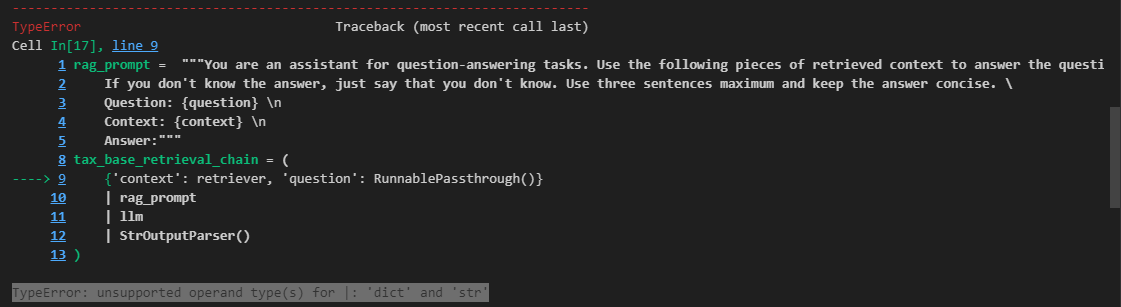

문제 요약

현재 hub.pull('rlm/rag-prompt')를 사용하셨고, tax_base_retrieval_chain을 구축하는 과정에서 TypeError가 발생하셨다고 하셨습니다. 이 오류는 일반적으로 사전(dictionary)와 문자열 간의 연산이 부적절하게 이루어졌을 때 발생할 수 있습니다.

문제 원인 및 해결 방안

프롬프트 템플릿의 호환성 문제

- 이 오류는

rlm/rag-prompt에서 가져온 프롬프트가tax_base_retrieval_chain의 입력 사전에 제대로 주입되지 않는 경우 발생할 수 있습니다. 특히, 사전과 문자열은 ‘|’ 연산자로 합칠 수 없습니다.

- 이 오류는

프롬프트 템플릿 확인 및 수정

- 프롬프트 템플릿이 기대하는 입력 형식과 실제 제공되는 데이터의 타입 및 형식을 확인해 보세요. 프롬프트는 대개 특정 변수(예:

context,question등)를 기대합니다. 해당 변수들이 제대로 정의되어 있는지 확인해야 합니다.

- 프롬프트 템플릿이 기대하는 입력 형식과 실제 제공되는 데이터의 타입 및 형식을 확인해 보세요. 프롬프트는 대개 특정 변수(예:

hub.pull을 통한 템플릿 가져오기 오류 해결

hub.pull을 통해 프롬프트를 가져왔을 때 제대로 로드되지 않는 경우, 특정 버전의 호환성 문제일 수 있습니다. 직접 텍스트를 사용하여 새로운 프롬프트를 정의해보세요.

- 텍스트로 프롬프트 템플릿을 정의할 경우,

PromptTemplate클래스를 사용합니다.

관련 링크 참고

아래는 PromptTemplate을 직접 사용하는 예제입니다:

from langchain import PromptTemplate

prompt_text = "Please answer the following question using the provided context: {context}.\nQuestion: {question}\nAnswer:"

prompt_template = PromptTemplate.from_template_string(

name="rag_prompt",

template=prompt_text,

variables=["context", "question"]

)

위 코드를 참고하여 문제를 해결해 보시기 바랍니다. 추가적으로 궁금하신 점이 있다면 댓글로 남겨주시면 감사하겠습니다.

저는 질문자님의 이해를 돕고자 지식공유자님의 기존 답변을 참고하여 유사한 답변 링크를 추천해드리고 있습니다. 현재 베타 기능으로 답변이 만족스럽지 않을 수 있는 점 양해 부탁드립니다. 🙏 추가적으로 궁금한 점이 있으시면, 이어서 질문해 주세요. 곧 지식공유자께서 답변해 주실 것입니다.

max token을 제한하는게 왜 성능을 개선하게 되는걸까요?

0

35

2

pyzerox 유니코드 에러

0

75

2

영상 메타데이터 생성 관련 LLM 활용 질문

0

67

1

종합부동산세 부분 tool 사용 질문 드립니다.

0

74

2

uv sync 파이썬 버전문제 onnxruntime

-1

103

2

MCP를 활용해서 간단한 에이전트를 만들어보세요

0

96

1

PDF 형식

0

64

1

5.3 langchain-mcp-adpater를 활용한 MCP 도구 사용 tool_list 지연 사유

0

91

2

3.6 human_in_the_loop 3rd case

0

81

1

summary 를. 시스템메세지에 추가하는 부분에 관하여

0

70

3

병렬 처리 중 retrieve 관련 궁금한 사항

0

76

1

query 에 대한 answer 결과값이 나오지 않습니다.

0

94

2

사람과 관련된 표현이 없는데 rewrite 로 이동하지 않는경우

0

75

1

retriever 관련 질문

0

65

1

인터룹 관련 질문

0

49

2

2.4 Self-RAG 결과가 달라요!

0

77

2

md vs txt 차이..

0

134

2

OpenAI API 호출 때문에 발생하는 Error code: 429 문제

0

112

2

단순 도구 사용과 도구를 가진 에이전트를 사용하는 것의 차이가 궁금합니다.

0

88

1

LangChain과 LangGraph v1

0

136

1

2.4 강의 관련 질문(답변을 검증하는 self rag)

0

73

2

후속강의 문의

0

73

2

3.6 강의 관련 질문(interrupt 관련)

0

50

1

그래프 구현 조언 부탁드립니다!

0

76

2