런타임 유형 변경 및 토크나이저 관련 에러

안녕하세요 코랩 실습 과정 중

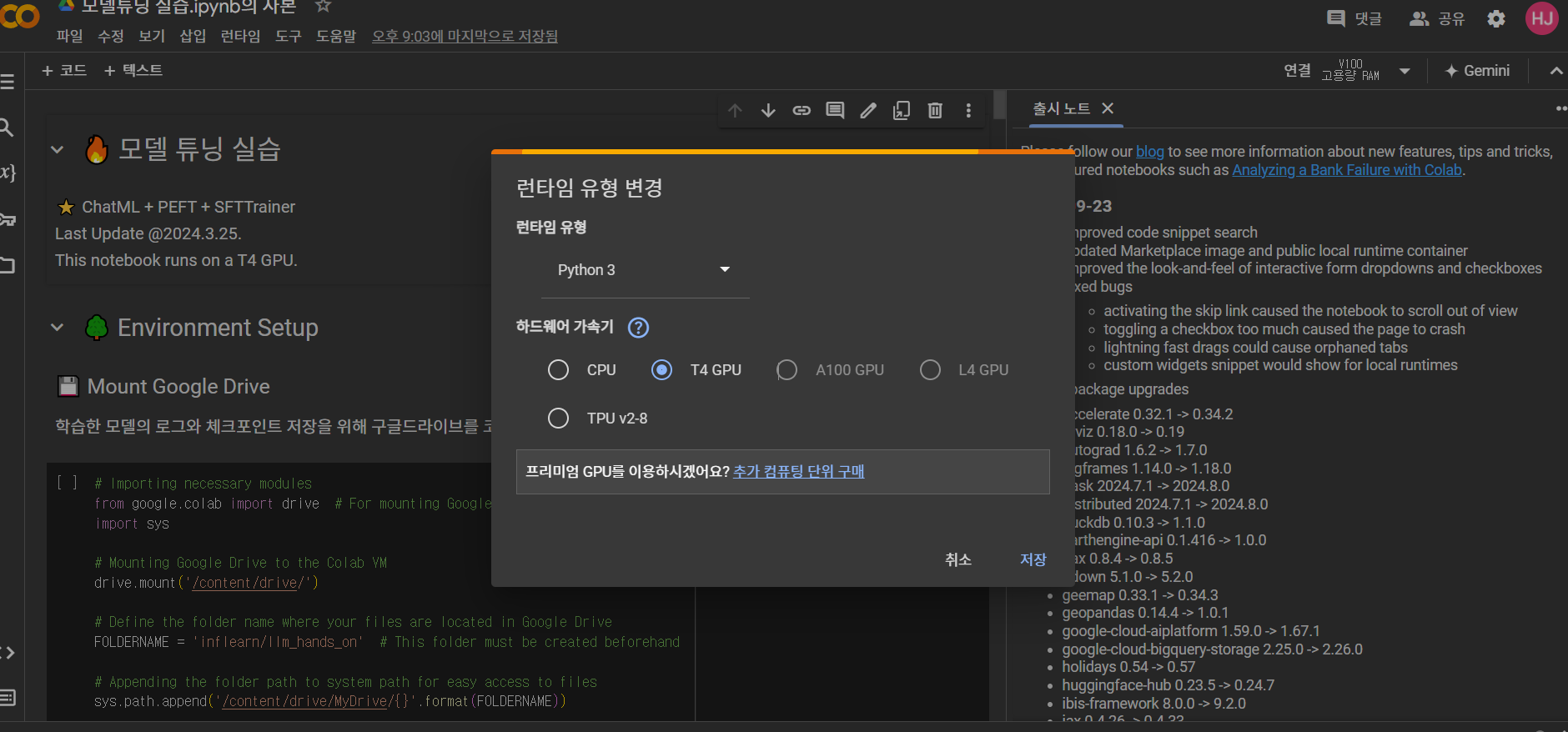

하드웨어 가속기 선택할 때 V100이 비활성화 되어있을경우 어떤 것을 선택해야 하는지 문의 드립니다.

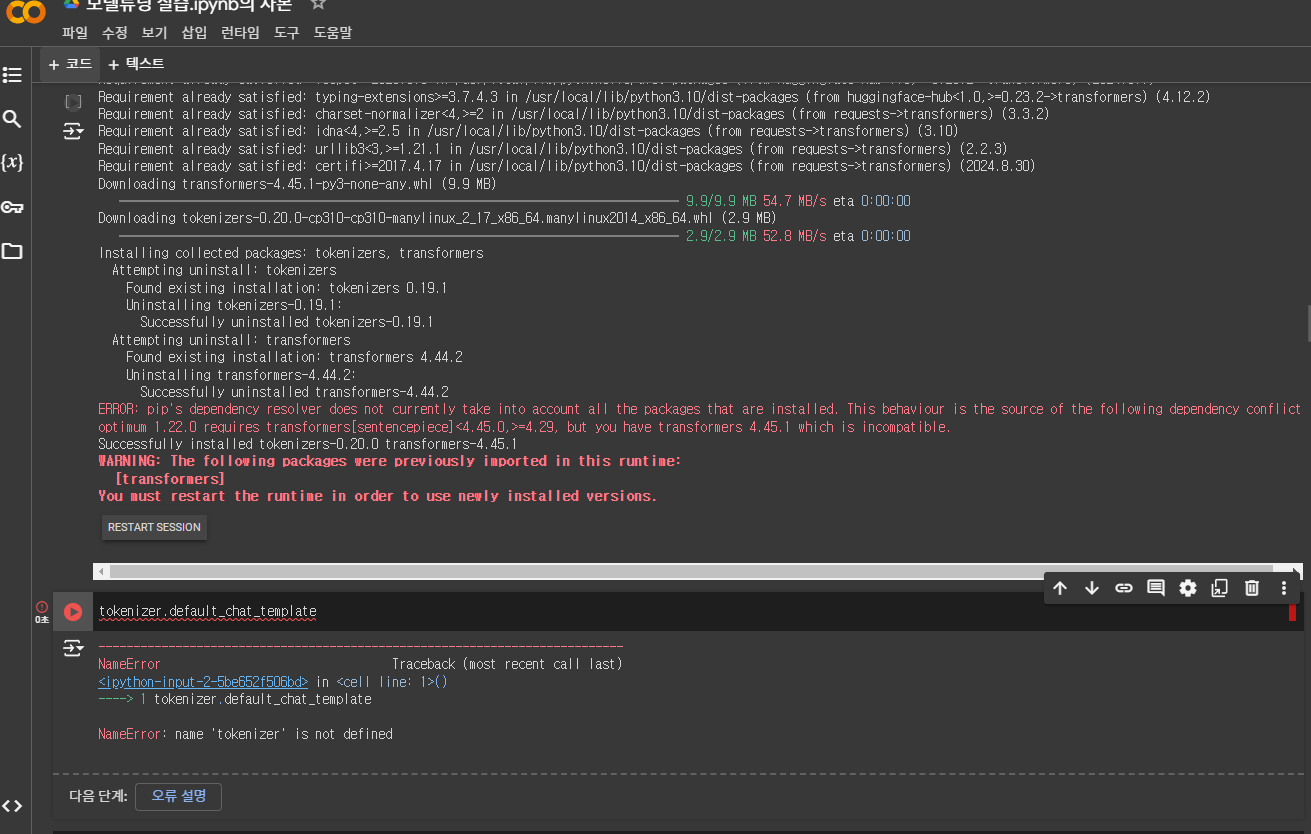

아울러 모델튜닝 실습 중 tokenizer.default_chat_template 부분에서 에러가 뜨는데 다음 단계로 넘어갈 수 있도록 하는 방법이 있을까요?

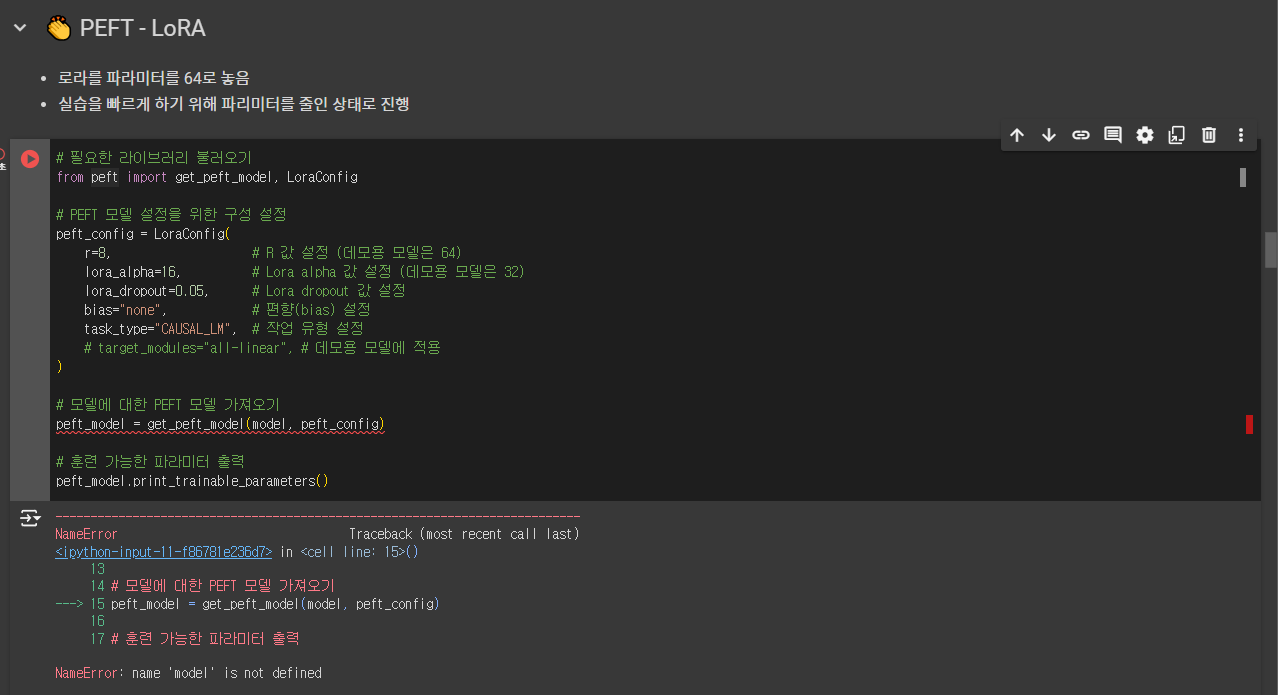

이후 패스하고 넘어간다고 해도 PEFT - LoRA부분에서도 에러가 뜹니다.

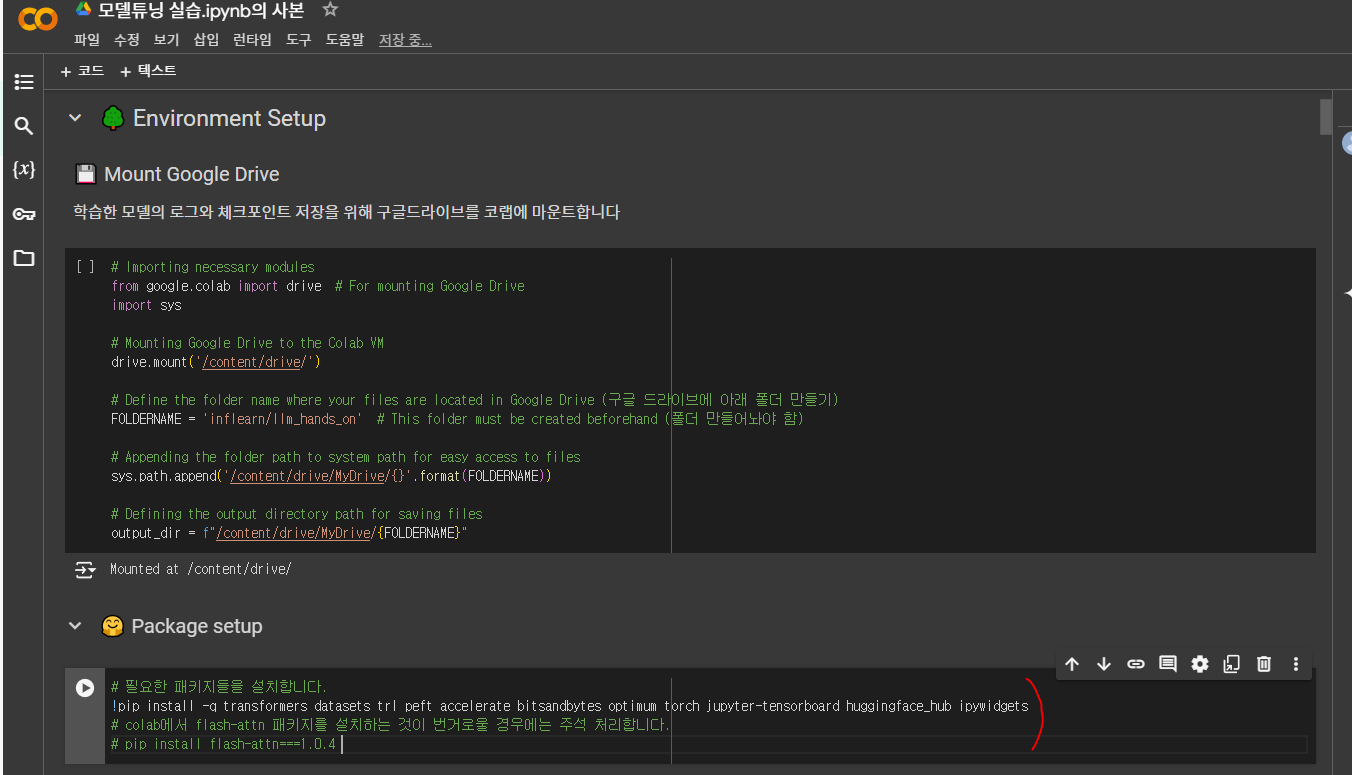

혹시 위 부분에서 pip install flash-attn===1.0.4 부분을 처리하지 않아서 오류가 난 것일까요?

답변 2

1

[1] A100 > V100 > T4 순으로 사용하시면 됩니다 가장 좋은건 역시 A100이긴합니다

[2] 최신버전 hf에서는 llama2의 chat template이 depreciated되었습니다. llama3를 사용하시거나 default_chat_template을 무시하시고 진행하셔도됩니다 (저희가 어차피 따로 chat_template을 넣어주기 때문에)

[3] flash-attn은 사용하시면 좋지만 colab 환경에서 지원되지 않는 경우가 아직까진 있어서 참고용으로 주석만 처리해두었습니다. peft 에러를 보니 model을 참조하지 못하는것 같은데, peft를 적용할 모델 선언 후 실행하면 동작할것으로 보입니다

0

안녕하세요,

오류부분에 대한 실습 코드를 업데이트했습니다

trl의 sfttrainer 부분이 업데이트되다보니, 다르게 동작했던것 같습니다

이후에도 이슈발생하시면 공유주시면 감사하겠습니다

40강 Multi GPU 필요성 설명이 두번 나오는 것 같아요

0

18

0

There are no longer any instances available with the requested specifications. Please refresh and try again.

0

27

2

버전에 3.11이랑 3.11.X 랑 차이가 있나요?

0

22

1

왜 파이썬 버전을 같게 해야하는가?

0

35

3

poetry 설정을 어떻게 해야하나요?

0

38

5

강의 잘 들었습니다!!

0

33

1

강의 수강 순서

0

45

1

13, 14강 진행되지 않는 문제

0

22

1

import 오류

0

26

1

온톨로지 활용

0

44

2

질문있는데요.. vLLM은 말씀하신 사양에 적용이되나요?

0

48

2

제공해주신 레포가 Windows 환경에 너무 비친화적입니다.

0

44

2

자동화 프로그램 프로젝트

0

26

1

수업 내 사용되는 프롬프트 등 강의 자료

0

25

1

개발환경에 대해셔 설명부탁드립니다.

0

27

1

수업자료 및 프롬프트 어디서 다운 받는 건가요?

0

26

1

챌린지 과제 문의

0

38

1

ollama설치해서 llama로 돌려도 되나요?

0

48

2

라이브 수강 어려움

0

55

3

어텐션의 정의

0

18

1

섹션22 퀴즈 질문

0

41

1

colab 실습 에러 질문

0

190

2

폐쇄 환경에서 챗봇

0

205

1

에러가 나네요

0

342

1