simple consumer 실행 시 무한 로그 찍힘

423

작성한 질문수 2

안녕하세요!

강의를 열심히 따라가는 중입니다.

simple consumer 개발 시 실행을 하면

15:46:20.636 [main] DEBUG org.apache.kafka.clients.FetchSessionHandler - [Consumer clientId=consumer-test-group-1, groupId=test-group] Built incremental fetch (sessionId=349253680, epoch=15) for node 0. Added 0 partition(s), altered 0 partition(s), removed 0 partition(s) out of 1 partition(s)

15:46:20.636 [main] DEBUG org.apache.kafka.clients.consumer.internals.Fetcher - [Consumer clientId=consumer-test-group-1, groupId=test-group] Sending READ_UNCOMMITTED IncrementalFetchRequest(toSend=(), toForget=(), implied=(test-0)) to broker localhost:9092 (id: 0 rack: null)

15:46:21.150 [main] DEBUG org.apache.kafka.clients.FetchSessionHandler - [Consumer clientId=consumer-test-group-1, groupId=test-group] Node 0 sent an incremental fetch response with throttleTimeMs = 0 for session 349253680 with 0 response partition(s), 1 implied partition(s)

15:46:21.150 [main] DEBUG org.apache.kafka.clients.consumer.internals.Fetcher - [Consumer clientId=consumer-test-group-1, groupId=test-group] Added READ_UNCOMMITTED fetch request for partition test-0 at position FetchPosition{offset=0, offsetEpoch=Optional.empty, currentLeader=LeaderAndEpoch{leader=Optional[localhost:9092 (id: 0 rack: null)], epoch=0}} to node localhost:9092 (id: 0 rack: null)

15:46:21.150 [main] DEBUG org.apache.kafka.clients.FetchSessionHandler - [Consumer clientId=consumer-test-group-1, groupId=test-group] Built incremental fetch (sessionId=349253680, epoch=16) for node 0. Added 0 partition(s), altered 0 partition(s), removed 0 partition(s) out of 1 partition(s)

15:46:21.150 [main] DEBUG org.apache.kafka.clients.consumer.internals.Fetcher - [Consumer clientId=consumer-test-group-1, groupId=test-group] Sending READ_UNCOMMITTED IncrementalFetchRequest(toSend=(), toForget=(), implied=(test-0)) to broker localhost:9092 (id: 0 rack: null)로그가 이런식으로 무한대로 찍히고

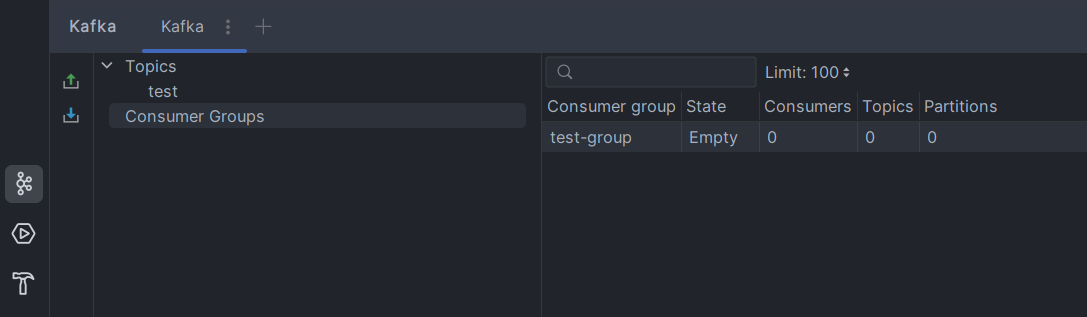

스프링부트의 카프카 라이브러리를 통해 확인을 하면

이렇게 상태가 empty라고 뜨며

이렇게 상태가 empty라고 뜨며

디버깅을 해보면 레코드에 데이터가 들어오지 않는 것을 확인 할 수 있습니다.

혹시 어느부분을 설정을 해주지않아서 그럴까요..?

kafka-console-producer 스크립트를 통해서 메시지를 생성하면 읽을수 있긴 합니다..

16:00:43.464 [main] INFO wendy.consumer.simpleconsumer.SimpleConsumer - record: ConsumerRecord(topic = test, partition = 0, leaderEpoch = 0, offset = 1, CreateTime = 1703660442453, serialized key size = -1, serialized value size = 12, headers = RecordHeaders(headers = [], isReadOnly = false), key = null, value = is it work??)답변 1

consume 이후 lag가 줄어들지 않음

0

74

2

안녕하세요. 강의의 카프카 버전과 현재 시점의 카프카의 차이점 문의 드립니다.

0

112

2

멱등성 프로듀서 retries 관련 질문입니다.

0

97

2

채팅 서비스 개발 시 주의점이 있을까요?

0

98

2

충분히 큰 파티션 생성시 궁금증이 존재합니다.

0

86

2

KTable 키가 없는 레코드 처리

0

72

2

컨슈머 테스트 코드 작성

0

94

2

리밸런스 onPartitionRevoked이 필요한 상황

0

74

2

카프카 클러스터에서 감당 가능한 파티션(레플리카) 수 문의

0

119

2

reset offset 질문

0

77

2

KStreamJoinKTable 실행시 오류

0

77

2

auto.commit.interval.ms 옵션 관련 질문 드립니다.

0

141

2

파티션, 컨슈머 그룹, 컨슈머 관련 질문

0

117

1

java, kotlin

0

130

2

shutdownThread 에 대한 문의 입니다.

0

153

2

zookeeper실행시 오류가 발생합니다.

0

267

2

커스텀 소스 커넥터에서 Thread.sleep (1000) 은 왜 하는거에요?

0

152

2

처리량을 늘리기 위해서 파티션을 늘리고 컨슈머를 늘려야한다고 설명하셨는데요

0

180

3

파티션 개수와 컨슈머 개수의 처리량 관련 질문

0

163

2

동영상 및 이미지 처리 관련 문의 드립니다.

0

224

2

주키퍼 없이 사용 문의 드립니다.

0

302

1

kafka 를 띄우니 오류가 발생하고 종료합니다.

0

280

3

zookeeper 실행시 오류 .. 무엇을 해야 할까요?

0

220

2

파티션 추가로 해결할 수 있지만 늘어난 파티션은 줄일 수 없지 않나요?

0

192

2