Encoder-Decoder 실습 질문드립니다.

359

작성한 질문수 1

Encoder-Decoder 실습 질문드립니다.

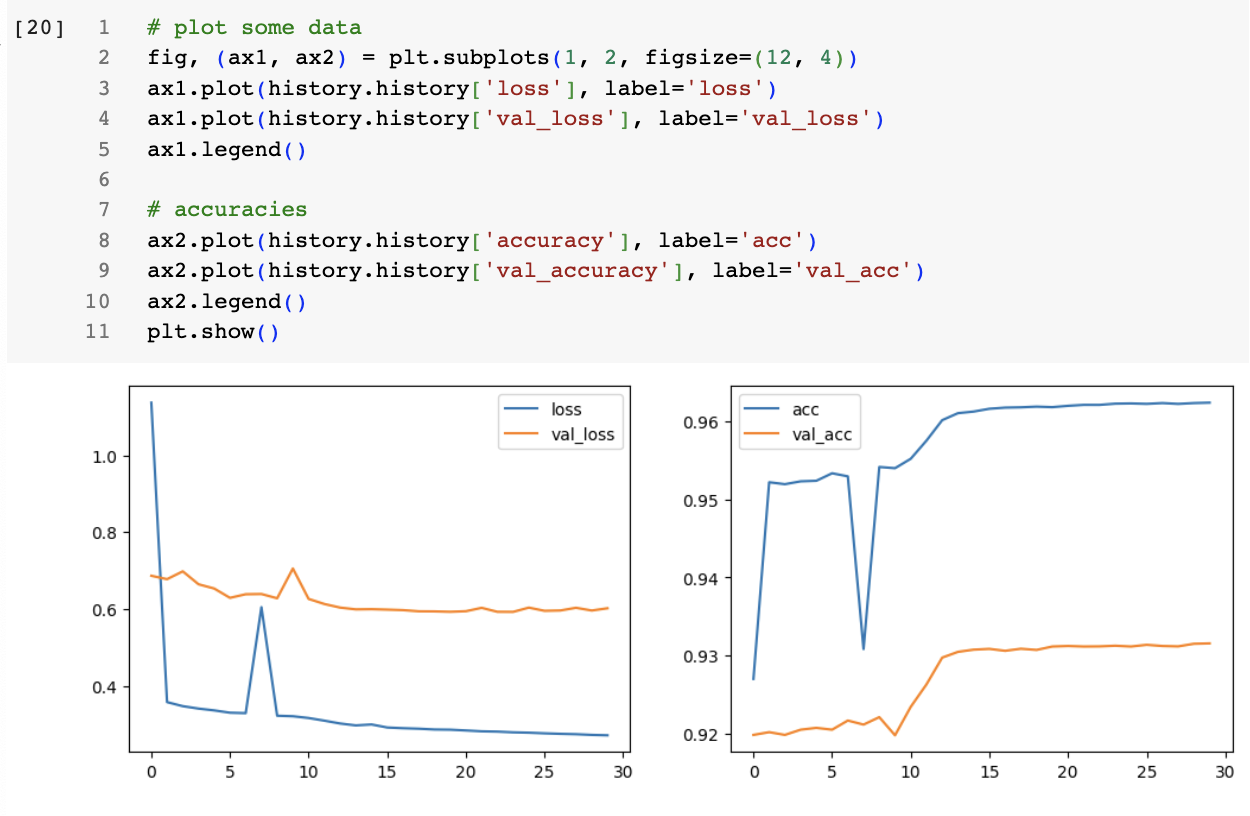

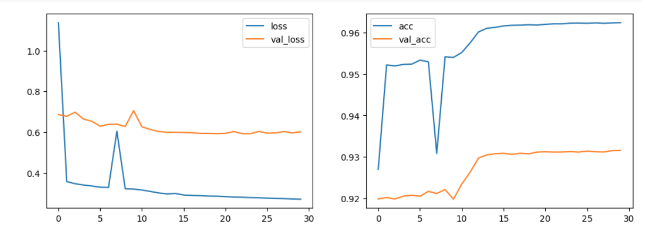

직접 실습을 하면서 강의영상과 실습 결과의 차이가 커서 모델 성능이 떨어져보이는데 어떤 부분을 건드려봐야할까요?

답변 2

0

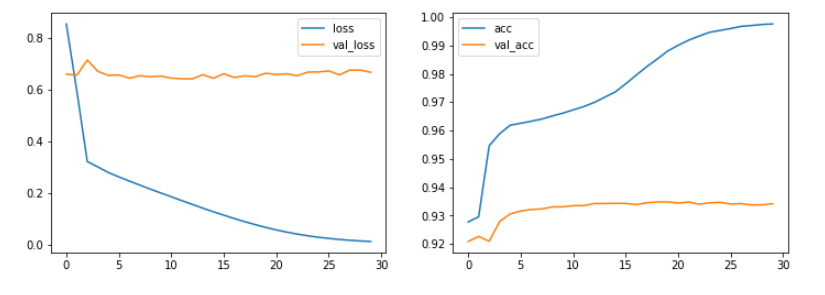

이 것이 교재에 포함되어 있던 loss/val_loss 와 acc/val_acc 플롯인데 위에 첨부하신 플롯과 크게 차이가 없습니다.

이 것이 교재에 포함되어 있던 loss/val_loss 와 acc/val_acc 플롯인데 위에 첨부하신 플롯과 크게 차이가 없습니다.

둘다 loss 는 줄어드는데 val-Loss 는 별로 줄어들지 않는 전형적인 overfitting의 모습을 보이고 있습니다.

둘다 loss 는 줄어드는데 val-Loss 는 별로 줄어들지 않는 전형적인 overfitting의 모습을 보이고 있습니다.

이러한 현상은 딥러닝 모델의 학습 데이터가 충분하지 않을 때 흔히 볼 수 있는 현상입니다.

조금 더 진도를 나가시면 이러한 RNN 을 이용한 딥러닝 언어 모델의 문제점이 어떻게 해결되었는지 이해하실 수 있습니다. 즉, Transformer 를 이용해 딥러닝 모델 사이즈의 확장과 대용량의 데이터를 이용한 overfitting 문제 해결을 하게 되었고 요즘 핫 이슈가 되고 있는 ChatGPT 같은 LLM (Large Language Model)의 탄생 배경이 되게 되었습니다. 문제는 Transformer 를 이용한 대형 언어 모델은 어차피 우리가 직접 만들 수 없는 size 이고 데이터 용량도 강의 교재로 사용 불가능한 크기 입니다. 다만 그 원리를 이해하기 위해 Colab 이나 local PC 에서 실행 가능한 크기의 RNN을 이용한 encoder-decoder 모델을 만든 것 이므로 딥러닝 언어 모델의 성능을 크게 기대하지는 마시고 혹시 교재에서와 같이 그럴 듯한 대화나 번역이 되기를 원하신다면 가능한 Training data 에 포함된 문장과 비슷한 문장을 입력하시기 바랍니다. 저도 그럴듯하게 보이는 교재를 만들기 위해 https://github.com/ironmanciti/NLP_lecture/raw/master/data/kor.txt 데이터 내용을 들여다 보고 비슷한 문장을 입력하였습니다. 어차피 Transformer의 작동 원리를 이해하기 위한 과정이므로 성능 보다는 원리 파악에 중점을 두시기 바랍니다.

좋은질문 감사합니다.

트랜스포머 FeedForward 관련 질문

0

71

2

파라미터갯수에대한질문(030_IMDB_movie_reviews)

0

61

1

Transformer 번역기 분석 - Part1 따라치기 질문

0

70

2

Encoder-Decoder 질문 드립니다.

0

73

2

model 코드 부분을 따라하다가 전 값이 이상해서요

0

83

1

서적 추천

0

77

1

NLP와 LLM의 차이점

0

557

2

encoder-decoder model 질문입니다.

1

74

1

구글번역기에 대해서 궁금한점이 있습니다.

0

124

2

로드맵에대해서...

0

120

2

Bag of Word (BOW)와TF-IDF시 대명사인 I의행방

0

97

2

강의 교재 최신화 요청

0

145

4

self-attention에서 Wq, Wk, Wv weight matrix 학습과정 질문드립니다.

0

189

3

코랩 환경 설정할 때 질문이 있습니다.

0

248

1

transformer 훈련 마친 모델 공유 가능할까요?

0

217

2

130_Transformer.ipynb transformer.summary() 에러

0

183

2

강사님 궁금한게 있어 문의 드립니다.

0

129

1

강사님 Tensorflow 실습코드 중 궁금한 점이 있습니다.

0

125

1

패딩과 관련한 질문 드립니다.

0

172

1

Encoder Decoder 부터 Simple Chatbot까지 이상답변

0

219

1

seq2seq 모델

0

327

1

강의 내용중 질문있습니다.

0

198

1

Transformer 번역기 부분에 대해 질문 있습니다.

0

213

1

320_Custom_Sentiment_Analysis_navermovie.ipynb 실행 시 오류 납니다.

0

316

2