7.8 실습문의

451

작성한 질문수 2

deployment-anti-podAffinity.yaml 실행했을 때 w2-k8s 2개, w3-k8s 2개의 배포 됩니다.

scale 명령으로 파드수를 줄였다가 늘려 보아도 동일합니다.

[root@m-k8s 7.8]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

deploy-anti-podaffinity-7865bcd85-b55tb 1/1 Running 0 10s 172.16.132.28 w3-k8s <none> <none>

deploy-anti-podaffinity-7865bcd85-g87kp 1/1 Running 0 10s 172.16.132.23 w3-k8s <none> <none>

deploy-anti-podaffinity-7865bcd85-kw7kp 1/1 Running 0 10s 172.16.103.180 w2-k8s <none> <none>

deploy-anti-podaffinity-7865bcd85-z99xl 1/1 Running 0 10s 172.16.103.181 w2-k8s <none> <none>

답변 3

0

안녕하세요

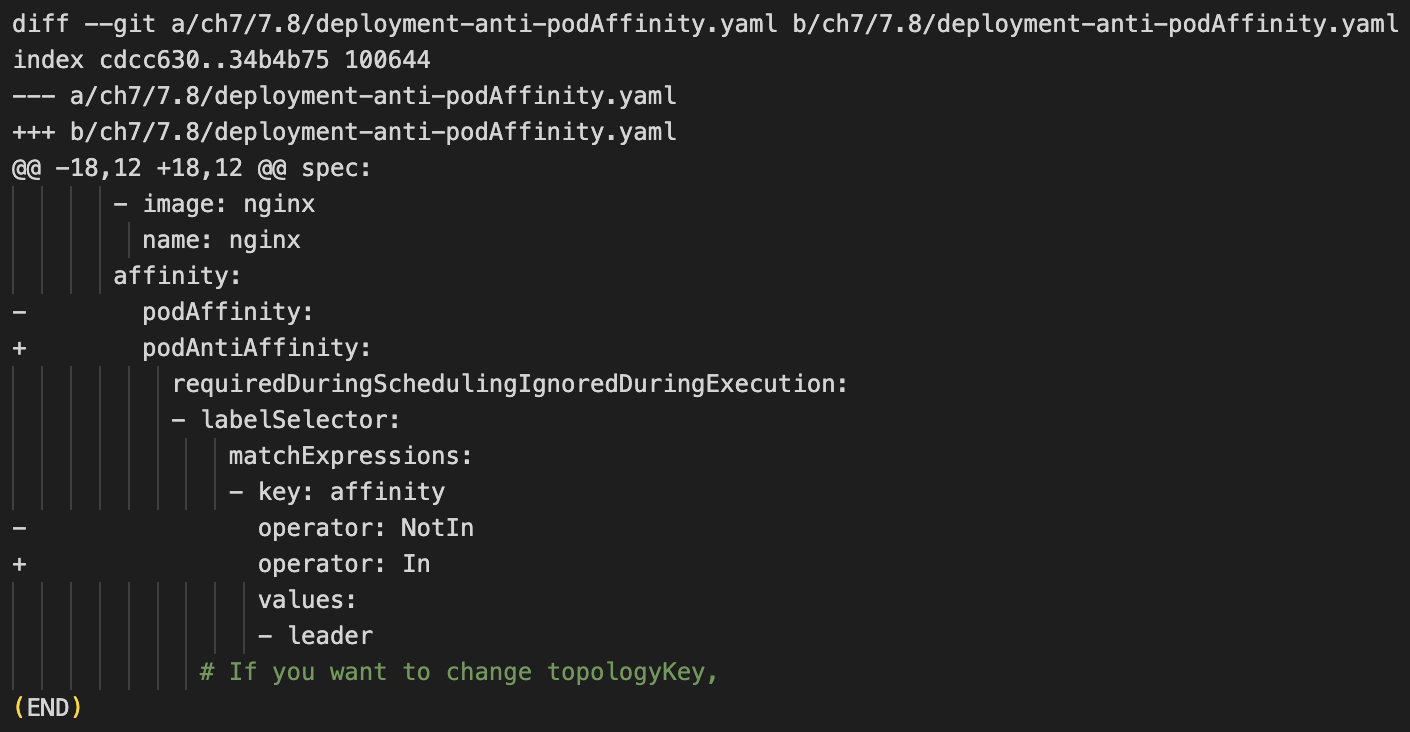

Pod 안티 패턴의 경우 일부 명세(Manifests)가 수정되어 업데이트 드립니다.

podAffinity의 공식 도큐먼트 설명은 안티 패턴이긴 한데....

디자인적으로는 NotIn의 경우 그러한 레이블이 없길 바란다. 라는 의미라고 합니다.

(이와 같은 철학으로 자매품 DoesNotExist가 있습니다.)

관련 링크:

Issue - Pod affinity with operator "NotIn" does not work #106795

Issue - Pod affinity with operator "DoesNotExist" does not work #90679

design-proposals-archive - Inter-pod topological affinity and anti-affinity

따라서 podAffinity를 podAntiAffinity로 수정하여 해당 기능을 구현하였습니다.

이에 따라 Operator도 NotIn에서 In으로 수정되었습니다. 수강에 참고 부탁드립니다.

이와 관련한 설명 문서는 다음과 같습니다.

Inter-pod affinity and anti-affinity

테스트 결과는 다음과 같습니다.

#bash

[root@m-k8s 7.8]# k get po -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

deploy-podaffinity-65cbd4f977-4cxxv 1/1 Running 0 63m 172.16.221.136 w1-k8s <none> <none>

deploy-podaffinity-65cbd4f977-9sk2j 1/1 Running 0 63m 172.16.132.2 w3-k8s <none> <none>

deploy-podaffinity-65cbd4f977-w5vqr 1/1 Running 0 64m 172.16.221.133 w1-k8s <none> <none>

deploy-podaffinity-65cbd4f977-xmttc 1/1 Running 0 63m 172.16.132.3 w3-k8s <none> <none>

w1-affinity-leader 1/1 Running 0 65m 172.16.221.131 w1-k8s <none> <none>

w3-affinity-leader 1/1 Running 0 64m 172.16.132.1 w3-k8s <none> <none>

#bash

[root@m-k8s 7.8]# k apply -f deployment-anti-podAffinity.yaml

deployment.apps/deploy-anti-podaffinity created

#bash

[root@m-k8s 7.8]# k get po -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

deploy-anti-podaffinity-fbf5cbf8d-557zz 1/1 Running 0 86s 172.16.103.139 w2-k8s <none> <none>

deploy-anti-podaffinity-fbf5cbf8d-5hcx5 1/1 Running 0 86s 172.16.103.136 w2-k8s <none> <none>

deploy-anti-podaffinity-fbf5cbf8d-9x4zm 1/1 Running 0 86s 172.16.103.138 w2-k8s <none> <none>

deploy-anti-podaffinity-fbf5cbf8d-jx4pb 1/1 Running 0 86s 172.16.103.137 w2-k8s <none> <none>

deploy-podaffinity-65cbd4f977-4cxxv 1/1 Running 0 65m 172.16.221.136 w1-k8s <none> <none>

deploy-podaffinity-65cbd4f977-9sk2j 1/1 Running 0 65m 172.16.132.2 w3-k8s <none> <none>

deploy-podaffinity-65cbd4f977-w5vqr 1/1 Running 0 66m 172.16.221.133 w1-k8s <none> <none>

deploy-podaffinity-65cbd4f977-xmttc 1/1 Running 0 65m 172.16.132.3 w3-k8s <none> <none>

w1-affinity-leader 1/1 Running 0 66m 172.16.221.131 w1-k8s <none> <none>

w3-affinity-leader 1/1 Running 0 65m 172.16.132.1 w3-k8s <none> <none>

0

pod-antiAffinity 설정후 pod 4개 배포시 w2-k8s 쪽으로 파드 4개가 모두 배포 되는 걸로 실습 예제에 나와 있는데요. 실제 실행을 해 보니 w2-k8s쪽 2개, w3-k8s쪽 2개로 배포가 되어서 생성된 파드를 scale 명령으로 replicas=1로 배포하고 다시 scale 명령으로 replicas=4로 배포를 했습니다.

결과가 w2-k8s쪽 2개, w3-k8s쪽 2개로 배포되어서 왜 이렇게 배포가 되는지 궁금해서 문의 했습니다.

0

안녕하세요, dukim73님.

튜터 주도입니다.

괜찮으시다면, 혹시 질문을 다시 구체적으로 부탁드려도 될까요?

우선 올려주신 질문은

"deployment은 replias를 scale통해서 줄이고 늘렸을 때에도 replicas의 수가 4개로 일정하다"

는 것으로 이해했습니다.

감사합니다.

섹션2. 1.5쿠버네티스_컨트롤플레인_노드와_워커_노드_그리고 kubeadm으로 쿠버네티스 직접 구성하기-v1.30 오류

0

56

2

[해결] 2.4. tabby config.yaml 파일 복사 실패 시

1

109

0

9.3 Error 발생 유도 테스트 확인 부탁드립니다.

0

106

2

livenessProbe 어플리케이션 재시작 의미

0

79

2

K8S 노들에 접근이 안됩니다.

0

182

6

arm virtualBox의 vagrant up 에러

0

122

2

추후 강의계획 질문

0

157

1

MAC 에서 사용할 수 있는 ova 파일은 없나요?

0

223

2

7.8. w3-affinity-leader 적용 에러 문제 질문드립니다.

0

225

5

커리큘럼 순서 문의

0

214

2

apply 실행 후 pod상태가 ContainerCreating 에서 변경이 안됩니다.

0

374

2

livenessProbe에 대한 설명이 조금 부족한거 같네요

0

225

3

controlplane_node.sh 실행 오류 문의

0

249

2

예제폴더의 경로와 영상의 경로가 너무나도 다릅니다

0

224

2

9.6강의 소스 수정 요청 및 에러 문의

0

174

2

8.6 강의 중 sysnet4admin/chk-info 이미지 bash 이슈

0

168

3

드디어 맥에서도 virtualbox가 지원 됩니다.

0

293

2

8.3강의 set-ctx-pod-admin.sh 수정 요청

0

126

3

7.5 강의 tardy-nginx 이미지 문제

0

3316

3

ch1. controlplan_node.sh 실행 시 에러가 뜹니다

0

312

3

Kubenetes 클러스터에 추가적으로 신뢰하는 CA를 넣을 수 있나요?

0

192

1

clusterrolebinding의 --namespace 옵션의 역할

0

171

2

A.0003 파일 vagrant file 수정 (자문자답)

0

172

2

nfs-client-provisioner 관련 생성 오류 질문

0

197

1