하루 만에 이해하는 랜섬웨어: 감염부터 대응까지 실전 보안 가이드

SecurityGround

₩16,500

입문 / 보안 교육

5.0

(2)

메일 한 통, 클릭 한 번으로 시작되는 랜섬웨어 사고. 보안 전공이 아니어도 이해할 수 있도록 실제 감염 흐름과 사고 사례를 기반으로 랜섬웨어의 원리부터 예방, 대응까지 한 번에 정리해드립니다.

입문

보안 교육

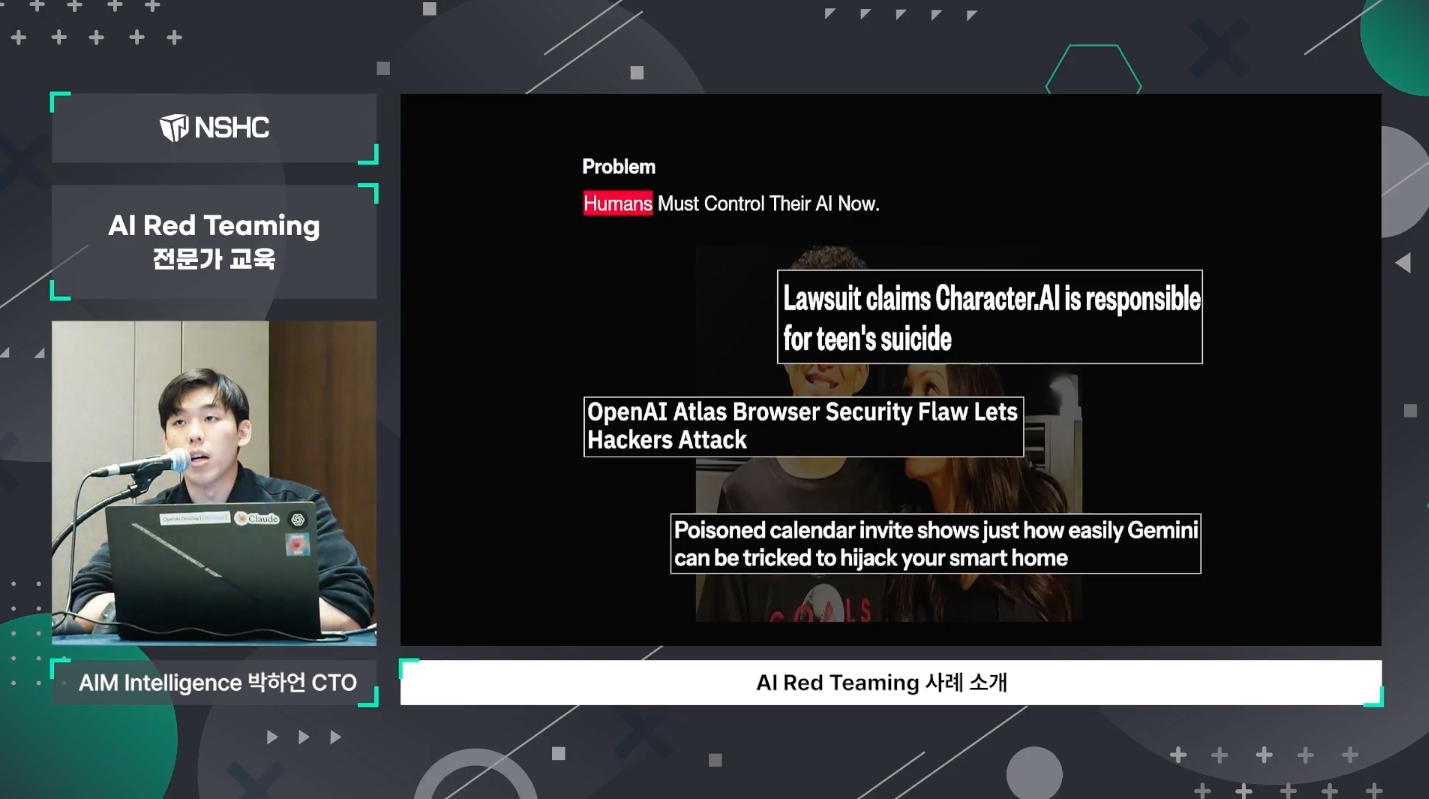

AI 시스템이 에이전트화(Agentic AI)되고, 텍스트를 넘어 이미지·오디오·멀티모달로 확장되면서 보안 위협 또한 훨씬 복잡해지고 있습니다. 이 강의는 AI Red Teaming 관점에서 AI Agent와 Multimodal LLM이 직면한 최신 보안 위협과 공격 기법, 그리고 실제 사례를 분석합니다.

유비큐테크놀로지

임직원들도 이 강의를 듣고 있어요!

유비큐테크놀로지

임직원들도 이 강의를 듣고 있어요!

AI Red Teaming 사고방식 이해

Agentic AI 위협 모델 파악

Multimodal LLM 보안 이슈 이해

AI 보안 전략 수립에 필요한 관점 확보

ChatGPT, Google Gemini, DeepSeek 등 AI 기술은 빠르게 발전하고 있습니다. 하지만 AI 기술이 발전하는 속도에 비해 AI 보안에 대한 대응은 현저히 느릴 뿐만 아니라 아직까지도 많은 이들의 관심을 받지 못하고 있습니다. NSHC에서는 2020년 AI 보안 연구소를 설립, 지금까지 이를 연구해오며 AI 보안에 대한 기초부터 심화까지 보안 교육 커리큘럼을 설계하였습니다. AI 가 그 어느 때보다 보편화 된 지금, 바로 AI Red Teaming 전문가 교육을 통해 기관 내 소중한 자산을 지켜보세요!

제1회 AI 보안 전문가 교육에는 특별히 AIM Intelligence와 함께 합니다.

AIM Intelligence는 Meta LLAMA 경진대회 아시아태평양상, 과학기술정보통신부 생성형 AI 레드팀 챌린지 수상 등의 경력을 가지고 있으며, 국제학회 IMCL 2025 및 ACL 2025에서 AI 보안 관련 연구가 채택된 강소기업입니다.

Transformer 아키텍처와 LLM 구조를 이해합니다.

LLM 특성 기반 공격 방법론을 학습합니다.

Jailbreaking, Next Token 공격, Safety Training의 한계를 분석합니다.

OWASP LLM Top 10과 Red Teaming 평가 지표를 이해합니다.

AI Agent Architecture와 IAM 구조를 이해합니다.

멀티에이전트 오케스트레이션 취약점을 분석합니다.

Vision·Audio 기반 Adversarial Attack 개념을 학습합니다.

실제 AI Red Teaming 사례를 통해 공격 시나리오를 이해합니다.

강의 자료 및 모든 영상·문서는 무단 배포 및 공유를 금지합니다.

학습 대상은

누구일까요?

AI 보안 전략을 설계하는 분

AI Red Teaming에 관심 있는 보안 실무자

LLM 보안 이후 단계의 심화 내용을 원하는 분

Agentic AI, Multimodal AI 보안이 궁금한 분

AI Safety 관점에서 공격 시나리오를 이해하고 싶은 분

선수 지식,

필요할까요?

LLM 기본 개념 이해

AI 보안 또는 정보보안 기초

생성형 AI 사용 경험

전체

5개 ∙ (2시간 12분)

지식공유자님의 다른 강의를 만나보세요!

같은 분야의 다른 강의를 만나보세요!

신규가입 25% 할인

월 ₩22,934

5개월 할부 시

25%

₩152,900

₩114,670