PEFT 실습 4에서 training시작할때 out of memory가 발생합니다.

316

작성한 질문수 2

PEFT 실습 4에서 training시작할때 out of memory가 발생합니다.

답변 1

0

안녕하세요~. 반갑습니다.

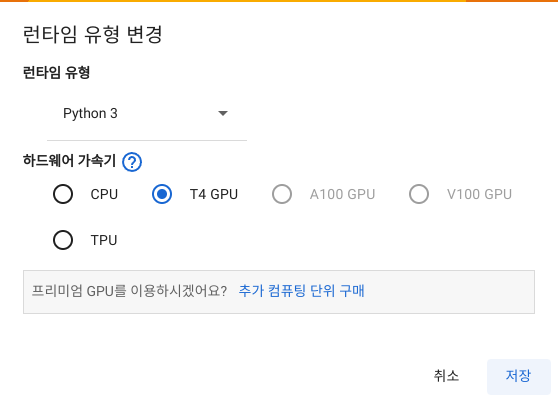

실습을 위해 제공드린 colab 코드에서 colab에서 무료로 사용할 수 있는 GPU 사양인 T4 GPU로 문제없이 학습이 진행되는 것을 확인하였는데요.

혹시 개인 GPU를 이용해서 학습중 Out of Memory 문제가 발생할 경우 아래 batch_size = 8 부분을

batch_size = 8batch_size = 2와 같이 배치 사이즈를 더 작은 값으로 설정해서 트레이닝을 시도해보시기 바랍니다.

좋은 하루 되세요.

감사합니다.

0

혹시 batch_size랑 별개로, num_epochs 크기도 메모리에 영향이 있을까요?

num_epochs는 예제값 50보다 높거나 낮추면 정확도에만 영향이 가나요?

섹션22 퀴즈 질문

0

30

1

LLM 기반 문서 유사도 산출 가능성 관련 문의드립니다

0

124

1

『6. LLM 용어 정리 - 인컨텍스트 러닝(In-context learning)』에 대한 문의

0

416

2

trainer.train() 실행했는데 API key를 입력하라고 합니다. ㅠ

0

142

2

open api 이용 방법

0

185

2

Llama vision 이미지 해상도

0

215

1

API 특정 짓는 법

0

142

2

소량의 fineTuning 이 미치는 영향

0

241

2

파인튜닝모델에게 일반적인 질문 할 경우에 대한 궁금증

0

223

2

모델에 대한 성능평가 방법

0

243

1

데이터셋을 파인튜닝 하는 것과 반대로 필요없는 데이터를 제거하는 방법도 있나요?

0

303

2

Lora 기법 질문

0

173

1

소스코드 다운받을 장소를 알려 주셔요.

0

150

1

섹션 20~23 강의자료가 없습니다.

0

139

1

학습시 API Key를 입력하라고 합니다.

0

962

2

OpenAI Assistants tools 중 retrieval 기능

0

140

0

OpenAI Assistants API 기초 예제 중 client.beta.threads.message.list 함수

0

135

1

Fine Tuning 후 inference 하는 예시(코드) 질문

0

245

1

PEFT_P-Tuning semantic similarity 예제 실행 오류

0

302

4

강사님 Step-back 학습자료가 없습니다.

0

163

2

학습 중지 후 재학습 방법(autotrain 최신 버전)

0

280

1

Fine-tuning 데이터셋 질문

0

301

1

Llama3 response 시간

0

499

2

fine-tuning 완료된 모델 관련 질문

0

229

2