MDP 상태가치 함수에서 기대값 관련 질문 드립니다.

412

작성한 질문수 2

안녕하세요, 선생님

MDP 상태가치 함수에서 정책의 기대값 식이 이해가 잘 안갑니다. 기대값은 앞강의에서 알려주신 바와 같이 gain x 확률의 총합으로 정의되는데 이 정책의 기대값은 조건부 확률 pi의 합인데 어떻게 기대값이 되는건가요?

답변 1

0

안녕하세요 Kevin Ryu님.

수강해주셔서 감사합니다.

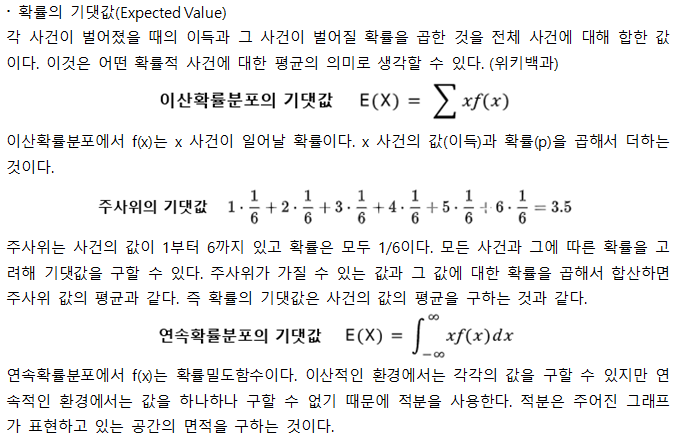

기대값은 위 그림에서와 같이 주사위가 가질 수 있는 값(보상)과 그 값에 대한 확률(정책)을 곱해서 합산하면 주사위 값의 평균과 같습니다. 즉 확률의 기댓값은 사건의 값의 평균을 구하는 것과 같습니다.

MDP에서 보상함수(R)를 계산하는 것 또한 주사위의 기댓값을 계산하는 것과 동일한 개념입니다. 주사위의 숫자는 보상과 같고, 그 숫자가 나올 확률은 정책과 같습니다.

감사합니다.

딥러닝 코드에 Batch Normalization 적용해보기 질문입니다

0

580

1

딥러닝으로 Regression 문제 적용해보기 (House Price Kaggle 문제) 질문입니다

0

478

1

Binary Classfication 딥러닝 적용해보기 질문입니다

0

366

1

파이토치 device (gpu / cpu) 관련 질문드립니다.

0

711

1

혹시 응용편은 어디서 볼 수 있을까요?

0

471

1

karting asset

0

434

2

using Unity.MLAgents; 오류

0

641

1

Augmentation 질문

1

389

1

cartpole_reinforce.ipynb 에러

0

530

2

DQN 알고리즘 실행 결과

0

357

1

DQN 코드 에러

0

494

1

DQN 질문

0

546

1

개발환경 구축관련 문의 드립니다.

0

230

1

MDP질문

0

207

1

MDP 질문

0

266

1

보상값과 보상함수

0

876

1

Reward 에 대한 질문 드립니다.

1

237

1

ppo에서 exploration을 어떻게 하는지 궁금합니다.

0

881

2

강의 외 질문입니다. Env 내부 action에 대한 질문입니다.

0

301

1

episode중간에 weight나 모델을 저장하고싶습니다.

0

941

2

action을 매 episode마다 출력하기위해서는 어떻게 해야하나요?

0

227

1

MDP 행동가치함수에 대한 문의 입니다.

0

404

1

TypeError: in user code: TypeError: Can not convert a NoneType into a Tensor or Operation.

0

1046

5

cartpole_dqn 중 def train_mini_batch(self,Q):에서 Q[0,0,action]의 0,0의 의미는?

0

201

1