질문드립니다.

267

投稿した質問数 23

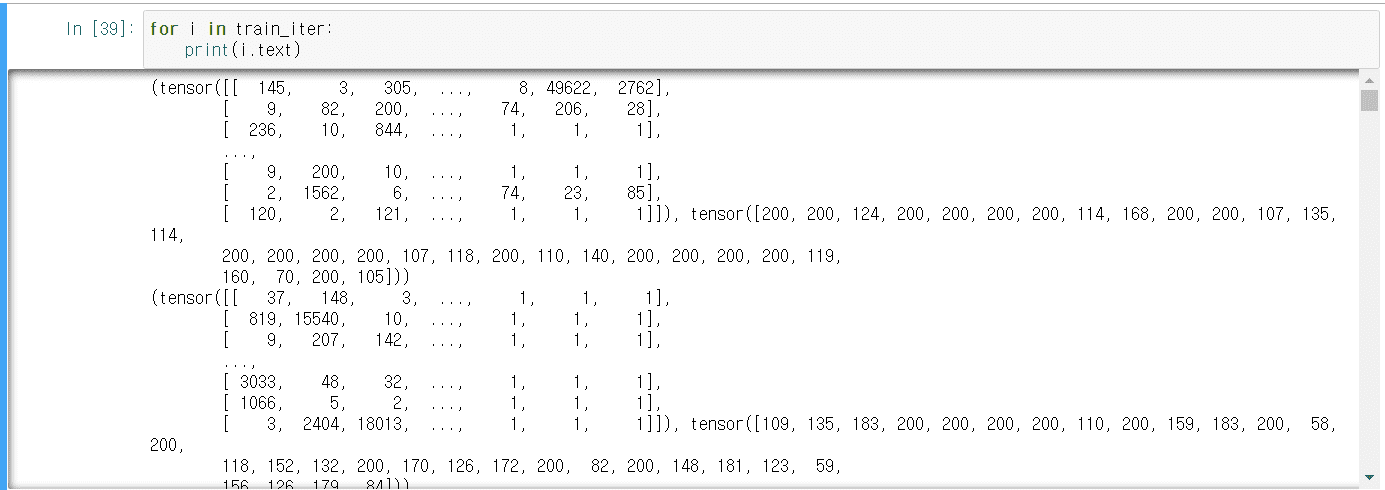

1. BucketIterator 함수가 배치사이즈별로 train, label을 분리해준다고 이해했는데 그 결과가 train_iter에 text[0],[1] 두개의 인덱스가 맞나요?

2.permute 는 각 차원의 위치를 바꿔는 역할을 하는데 permute(1, 0, 2) 0 ,1 ,2 가 각각 어던 차원을 의미하나요?

2.permute 는 각 차원의 위치를 바꿔는 역할을 하는데 permute(1, 0, 2) 0 ,1 ,2 가 각각 어던 차원을 의미하나요?

3.embedding_length = 300으로 주셨는데 입력값은 마음대로 조정할 수 있는건가요?\

4.Attention모델에서 인코더 마지막 히든스테이트 값이 디코더 시작부분으로 초기화 된다고 하셨는데 (제가 잘 이해한건지 모르겠네요) attn_weights = torch.bmm(lstm_output, hidden.unsqueeze(2)).squeeze(2) 에서 final_state는 디코더 첫번째 히든스테이트인가요? 상위 코드는 어텐션 스코어를 구해주는 코드인가요?

답변이 안될까요~

回答 1

0

안녕하세요, Justin 입니다.

늦게 답변드려 죄송합니다.

1. train, label이 아닌, text, label로 분리합니다. 같은 실습 코드 내 train_model 함수를 참고해보시면, batch.text[0], batch.label 값 각각이 X, y 에 해당됩니다.

2. permute는 벡터의 차원 순서를 재배치합니다.

예를 들어, permute(1, 0, 2)의 경우, 기존 벡터 차원이 [32, 16, 100] 에 적용하였을 때,

[16, 32, 100] 으로 변경됩니다.

>>> x = torch.randn(2, 3, 5) >>> x.size() torch.Size([2, 3, 5]) >>> torch.permute(x, (2, 0, 1)).size() torch.Size([5, 2, 3])

3. 네, 임베딩 벡터의 크기는 분석가 마음대로 조정할 수 있습니다.

4. final_state 값은 인코더의 히든스테이트 값 중 마지막 위치에 해당되는 벡터이므로, 이를 이용하여 디코더의 히든스테이트 값 중 첫 번째 위치로 지정합니다.

감사합니다.

import torch가 안되는 경우는 어떻게 하나요?

0

17

1

소리가 겹쳐서 들려요

0

23

2

20강에서 파인튜닝 때 사용한 데이터가 없어졌습니다. LoRA Trainer 매개변수도 라이브러리 업그레이드로 수정되었습니다.

0

20

1

[개정판] 딥러닝 컴퓨터 비전 완벽 가이드 먼저? 구현하며 배우는 Transformer 먼저?

0

30

1

전 강의와 전혀 이어지지가 않음

0

31

1

pytorch local 설치 옵션에 conda 가 없습니다.

0

38

3

pc에서는 괜찮은데 탭으로 들으니 화면확대시 화면이 까맙니다

0

22

1

모든 자료 다운로드 누를때마다 똑같은 excel파일이 다운로드 받아짐. 노션 주소 공유되나요?

0

32

2

강화학습저장 및 로드

0

57

1

paperswithcode 서비스 종료 관련 문의

0

209

2

batch size 질문이 있습니다!

0

468

1

torchtext.data 에러

0

2026

1

파이썬 코드 다운로드 받을 수 있는 곳이 있을까요?

0

546

1

train과 test 관련해서 질문드립니다!

0

262

1

혹시 audio관련해서 stt나 tts등 pytorch 관련해서 강의 하실 수 있나요?

0

368

1

teacher_force = random.random() < teacher_forcing_ratio

0

323

1

context_size 질문드립니다.

0

236

1

파이썬 for 문 질문드립니다.

0

257

1

Encoder와 Decoder Embedding에서 같은 벡터공간에 임베딩되는건가요?

0

272

1

word2vec

0

383

1

RNN과 CNN을 섞는법

0

295

2

13:30쪽 사운드가 너무 깨집니다ㅠㅠ

3

229

1

NLP에 RNN을 사용하는 이유

0

270

1

실습데이터 문의 - [실습]자연어 처리에 필요한 기본 배경 지식 실습

0

228

1