파라미터갯수에대한질문(030_IMDB_movie_reviews)

오영제 선생님 안녕하십니까?

수준높은 강의 잘 듣고 있습니다.

제공해 주신 소스중에

030_IMDB_movie_reviews.ipynb

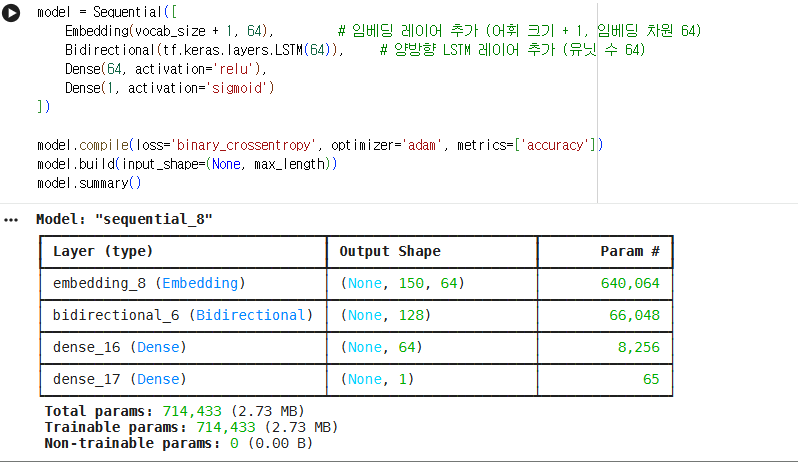

에 있는 아래의 model 에서 파라미터 숫자를 설명해 주실수 있으신지요?

Dense 쪽의 파라미터는 앞전 강의인 파이썬을 활용한 머신러닝 딥러닝 입문 의 실습 - Neural Network을 이용한 Linear Regression - Boston 주택 가격 예측

에서 16분 경에서 설명해 주신대로 설명이 되는데 위쪽 부분은 잘 이해가 가지 않습니다.

죄송하지만 간략하게라도 파라미터 갯수와 왜 이렇게 되었는지 설명해 주시면 감사하겠습니다.

감사드립니다.

回答 1

0

Embedding(vocab_size + 1, 64) → 10,001×64=640,064

Bidirectional(LSTM(64))

LSTM 한 방향의 파라미터 공식 : 4 × (d·u + u·u + u) = 4 × u × (d + u + 1)

u = 64 (LSTM 유닛 수), d = 64 (임베딩 출력 차원)

4×64×(64+64+1)=4×64×129=33,024

Bidirectional 이므로 2배: 33,024×2=66,048Dense(64, activation='relu')

바이디렉셔널 LSTM 출력(128) × 64(출력) + bias 64(뉴런마다 1개) = 128×64+64=8,256Dense(1, activation='sigmoid')

64(입력) × 1(출력) + bias 1 = 65

좋은 질문 감사합니다.

트랜스포머 FeedForward 관련 질문

0

69

2

Transformer 번역기 분석 - Part1 따라치기 질문

0

69

2

Encoder-Decoder 질문 드립니다.

0

71

2

model 코드 부분을 따라하다가 전 값이 이상해서요

0

83

1

서적 추천

0

75

1

NLP와 LLM의 차이점

0

550

2

encoder-decoder model 질문입니다.

1

73

1

구글번역기에 대해서 궁금한점이 있습니다.

0

122

2

로드맵에대해서...

0

120

2

Bag of Word (BOW)와TF-IDF시 대명사인 I의행방

0

94

2

강의 교재 최신화 요청

0

142

4

self-attention에서 Wq, Wk, Wv weight matrix 학습과정 질문드립니다.

0

189

3

코랩 환경 설정할 때 질문이 있습니다.

0

248

1

transformer 훈련 마친 모델 공유 가능할까요?

0

216

2

130_Transformer.ipynb transformer.summary() 에러

0

182

2

강사님 궁금한게 있어 문의 드립니다.

0

128

1

강사님 Tensorflow 실습코드 중 궁금한 점이 있습니다.

0

124

1

패딩과 관련한 질문 드립니다.

0

171

1

Encoder Decoder 부터 Simple Chatbot까지 이상답변

0

218

1

seq2seq 모델

0

323

1

강의 내용중 질문있습니다.

0

197

1

Transformer 번역기 부분에 대해 질문 있습니다.

0

212

1

320_Custom_Sentiment_Analysis_navermovie.ipynb 실행 시 오류 납니다.

0

314

2

201_classify_text_with_bert_tfhub_Kor.ipynb 오류

0

342

2