ppo에서 exploration을 어떻게 하는지 궁금합니다.

881

작성한 질문수 1

안녕하세요 강의 잘 듣고 이를 토대로 모델을 만들어서 학습하고 있습니다.

저는 ppo기반으로 학습을 진행했는데요

제가 만든환경에서 어느정도 학습이 이루어지면

환경이 조금 변화 되어 지속 학습을 하게끔하였습니다.

여기서 궁금한점은 제가 만든 환경에서 일부 환경이 바뀌게 되면

지금까지 최신화된 정책을 일부만 따르게 하고 액션을 랜덤하게 샘플링

하고 싶습니다.

q러닝에서는 e-greedy 개념으로 epsilon을 통해 액션을 랜덤하게

샘플링 하도록 조절하는데 ppo같이 stochastic 모델에서는

어떻게 해야하는지 잘 모르겠습니다 ㅠㅠ

답변 2

1

안녕하세요 굿초이님.

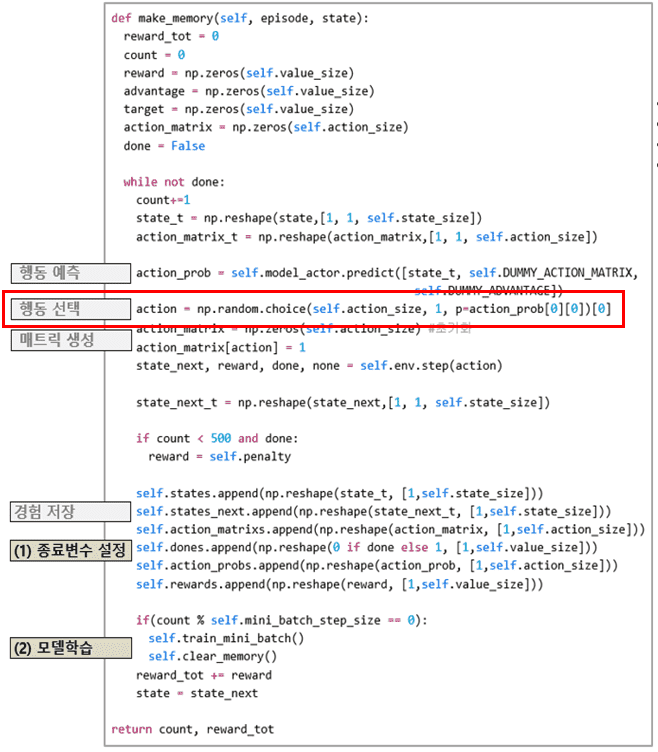

PPO 알고리즘에서 Exploration을 구현하기 위해 사용하는 방법은 make_memory 함수에서 확인할 수 있습니다.

행동을 선택할 때 np.random.choice 함수를 사용하고 인수로 각 행동별 확률을 가지고 있는 action_prob 변수를 넣어줍니다. 예를들어 0행동에 대한 확률이 0.6이고 1행동에 대한 확률이 0.4라면, np.random.choice 함수는 행동을 선택할 때 40%와 60%의 확률을 가지고 선택하게 됩니다. 즉, 0행동을 40%, 1행동을 60% 확률을 가지고 선택하게 됩니다.

감사합니다.

딥러닝 코드에 Batch Normalization 적용해보기 질문입니다

0

580

1

딥러닝으로 Regression 문제 적용해보기 (House Price Kaggle 문제) 질문입니다

0

478

1

Binary Classfication 딥러닝 적용해보기 질문입니다

0

366

1

파이토치 device (gpu / cpu) 관련 질문드립니다.

0

711

1

혹시 응용편은 어디서 볼 수 있을까요?

0

471

1

karting asset

0

434

2

using Unity.MLAgents; 오류

0

641

1

Augmentation 질문

1

390

1

cartpole_reinforce.ipynb 에러

0

530

2

DQN 알고리즘 실행 결과

0

357

1

DQN 코드 에러

0

494

1

DQN 질문

0

546

1

개발환경 구축관련 문의 드립니다.

0

230

1

MDP질문

0

207

1

MDP 질문

0

266

1

보상값과 보상함수

0

876

1

MDP 상태가치 함수에서 기대값 관련 질문 드립니다.

0

412

1

Reward 에 대한 질문 드립니다.

1

237

1

강의 외 질문입니다. Env 내부 action에 대한 질문입니다.

0

301

1

episode중간에 weight나 모델을 저장하고싶습니다.

0

941

2

action을 매 episode마다 출력하기위해서는 어떻게 해야하나요?

0

227

1

MDP 행동가치함수에 대한 문의 입니다.

0

404

1

TypeError: in user code: TypeError: Can not convert a NoneType into a Tensor or Operation.

0

1046

5

cartpole_dqn 중 def train_mini_batch(self,Q):에서 Q[0,0,action]의 0,0의 의미는?

0

201

1