혼자 공부하는 머신러닝+딥러닝

박해선

무료

초급 / 머신러닝, 딥러닝

4.8

(114)

한빛미디어 혼공시리즈로 1:1 과외하듯이 배우는 초절정 머신러닝, 딥러닝 자습서, 수백 개의 손그림으로 이해하고 구글 코랩(Colab)을 통해 브라우저만 있으면 바로 실습 가능

초급

머신러닝, 딥러닝

이 챌린지는 <밑바닥부터 만들면서 배우는 LLM>(길벗, 2025) 도서를 7주간 역자와 함께 완독하는 챌린지입니다. 챌린지와 도서에 대한 궁금증은 인프런 또는 역자 블로그(https://tensorflow.blog/llm-from-scratch/), 카카오톡 오픈채팅방(http://bit.ly/tensor-chat, 참여코드:flow)으로 언제든지 문의해 주세요.

53개 수업 학습

8회 미션 수행

무제한 복습, 내 것으로 만들어요.

질문하고 즉시 답을 얻어요.

성취의 증표, 수료증을 발급해요.

23,211

명

수강생

427

개

수강평

131

개

답변

4.9

점

강의 평점

11

개

강의

기계공학을 전공했지만 졸업 후엔 줄곧 코드를 읽고 쓰는 일을 했습니다. Google AI/Cloud GDE, Microsoft AI MVP입니다. 텐서 플로우 블로그(tensorflow.blog)를 운영하고 있고, 머신러닝과 딥러닝에 관한 책을 집필하고 번역하면서 소프트웨어와 과학의 경계를 흥미롭게 탐험하고 있습니다.

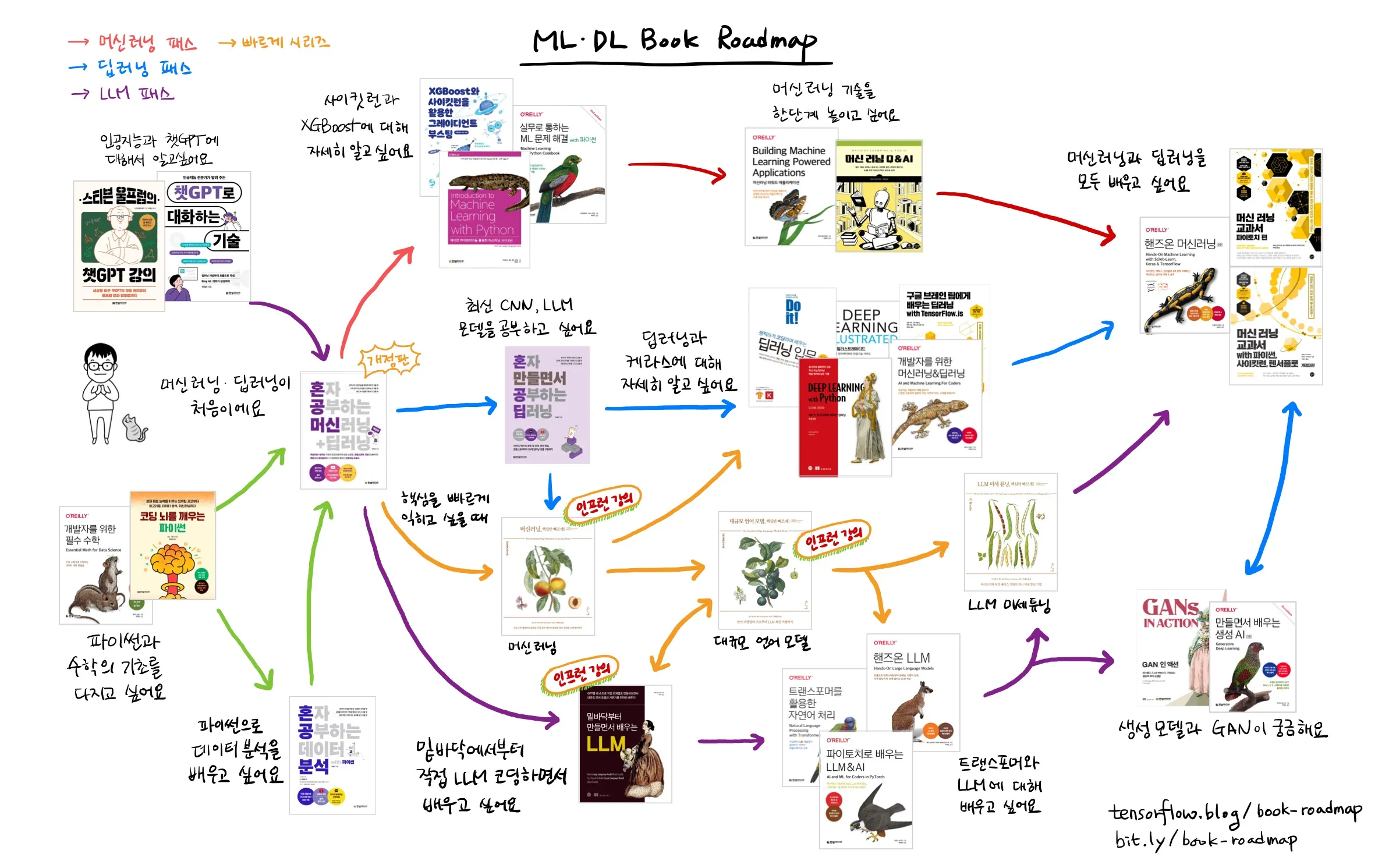

『혼자 만들면서 공부하는 딥러닝』(한빛미디어, 2025), 『혼자 공부하는 머신러닝+딥러닝(개정판)』(한빛미디어, 2025), 『혼자 공부하는 데이터 분석 with 파이썬』(한빛미디어, 2023), 『챗GPT로 대화하는 기술』(한빛미디어, 2023), 『Do it! 딥러닝 입문』(이지스퍼블리싱, 2019)을 집필했습니다.

『LLM 미세 튜닝, 핵심만 빠르게!』(인사이트, 2026), 『파이토치로 배우는 LLM & AI』(한빛미디어, 2026), 『대규모 언어 모델, 핵심만 빠르게!』(인사이트, 2025), 『머신러닝, 핵심만 빠르게!』(인사이트, 2025), 『밑바닥부터 만들면서 배우는 LLM』(길벗, 2025), 『핸즈온 LLM』(한빛미디어, 2025), 『머신 러닝 Q & AI』(길벗, 2025), 『개발자를 위한 수학』(한빛미디어, 2024), 『실무로 통하는 ML 문제 해결 with 파이썬』(한빛미디어, 2024), 『머신러닝 교과서: 파이토치 편』(길벗, 2023), 『스티븐 울프럼의 챗GPT 강의』(한빛미디어, 2023), 『핸즈온 머신러닝 3판』(한빛미디어, 2023), 『만들면서 배우는 생성 딥러닝 2판』(한빛미디어, 2023), 『코딩 뇌를 깨우는 파이썬』(한빛미디어, 2023), 『트랜스포머를 활용한 자연어 처리』(한빛미디어, 2022), 『케라스 창시자에게 배우는 딥러닝 2판』(길벗, 2022), 『개발자를 위한 머신러닝&딥러닝』(한빛미디어, 2022), 『XGBoost와 사이킷런을 활용한 그레이디언트 부스팅』(한빛미디어, 2022), 『구글 브레인 팀에게 배우는 딥러닝 with TensorFlow.js』(길벗, 2022), 『(개정2판)파이썬 라이브러리를 활용한 머신러닝』(한빛미디어, 2022)을 포함하여 수십여 권의 책을 우리말로 옮겼습니다.

10월

5일

챌린지 시작일

2025년 10월 5일 오후 03:00

챌린지 종료일

2025년 11월 30일 오후 02:59

전체

61개 ∙ (4시간 38분)

해당 강의에서 제공:

밑바닥부터 시작해서 완전한 LLM을 직접 코드로 구현합니다.

트랜스포머와 어텐션을 비롯해 LLM을 구성하는 핵심 컴포넌트를 배웁니다.

GPT와 유사한 LLM을 사전 훈련하는 방법을 배웁니다.

분류를 위해 LLM을 미세 튜닝하는 방법을 배웁니다.

사람의 지시를 따라 응답하도록 LLM을 미세 튜닝하는 방법을 배웁니다.

학습 대상은

누구일까요?

대규모 언어 모델(LLM)의 작동 원리를 상세하게 파악하고 싶은 분

파이토치와 transformers 패키지를 사용해 LLM을 사전 훈련하고 미세 튜닝하고 싶은 분

오픈AI의 GPT-2 모델의 구조를 알고 싶은 분

무엇이든 직접 만들어 봐야 직성이 풀리는 분!

선수 지식,

필요할까요?

파이썬 프로그래밍에 대한 기초 지식이 필요합니다.

파이토치에 익숙하지 않다면 책 뒤에 실린 부록 A를 참고하세요.

전체

90개

5.0

90개의 수강평

취소 및 환불 규정

챌린지는 지식공유자가 설정한 수업 최소 정원이 충족되지 않을 경우, 폐강 안내가 고지되며 결제 내역이 자동취소됩니다.

지식공유자님의 다른 강의를 만나보세요!

₩15,400

30%

₩22,000