55,000원

초급자를 위해 준비한

[수학] 강의입니다.

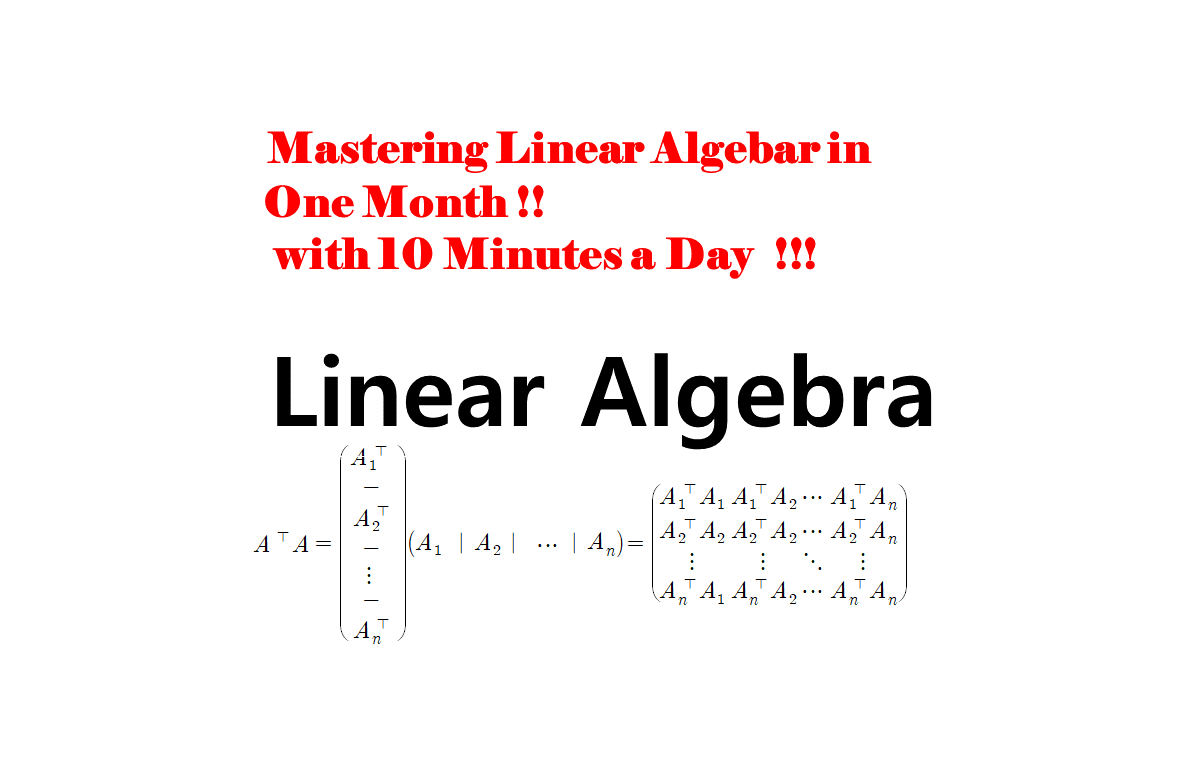

AI/딥러닝에 필요한 선형대수 내용을 하루 10분 투자 한 달 완성으로 마스터 해봐요

✍️

이런 걸

배워요!

이런 걸

배워요!

AI/딥러닝 필요한 핵심내용 만 집중공부

수학적 이론이 필요한 부분은 세세히

구체적인 예들을 사용 이론설명 머리에 쏙쏙

이런 분들께 추천드려요!

🎓

학습 대상은

누구일까요?

학습 대상은

누구일까요?

머신러닝, 딥러닝, 컴퓨터 비젼, 컴퓨터 그래픽, 이공계 분들

문과 공부한 분들도 추천해요

수학 기초가 부족하신 분들도 추천해요

📚

선수 지식,

필요할까요?

선수 지식,

필요할까요?

하고자 하는 의지는 필수

꾸준히 한 달 투자하실 수 있는 분

안녕하세요

임장환 입니다.

임장환 입니다.

박사 졸업 후 5년 정도 Computer vision를 공부하고 가르치는 계기가 돼서

지금까지 수학전공과 공학이론을 연결한 공부들을 하고 있습니다.

전문분야(공부 분야)

전공: 수학(Topological Geometry), 부전공(컴퓨터 공학)

현) 3D Computer Vision(3D Reconstruction) , Kalman Filter, Lie-group(SO(3)),

Stochastic Differential Equation 연구자

현) 유튜브 채널 운영: 임장환: 3D Computer Vision

현) facebook Spatial AI KR 그룹 (수학전문위원)

출신학교

독일 Kile 대학 이학박사 (Topological Geometry & Lie-group 전공, 컴퓨터 공학 부전공)

중앙대 수학과 학사, 석사(Topology 전공)

경력

전) 대성그룹 자회사 두비비젼 CTO

전) 중앙대학교 첨단영상 대학원 연구교수(3D Computer Vsion연구)

저서:

최적화이론: https://product.kyobobook.co.kr/detail/S000200518524

링크

유튜브: https://www.youtube.com/@3dcomputervision520

블로그: https://blog.naver.com/jang_hwan_im

커리큘럼

총 31 개

˙ 5시간 42분의 수업

이 강의는 영상, 첨부 파일이 제공됩니다. 미리보기를 통해 콘텐츠를 확인해보세요.

섹션 0. 0.1 행렬의 정의와 행렬의 연산, 선형방정식 소개

4 강

∙ 42분

0.1 선형대수 소개(Introduction to Linear Algebra)

미리보기

11:40

0.1행렬의 덧샘(Matrix Addition )

05:40

0.2행렬의 곱셈(Matrix Multiplication )

미리보기

10:17

선형방정식 소개(Introduction to Linear Equations )

14:58

섹션 1. 1. 벡터공간 소개

7 강

∙ 1시간 35분

벡터개념의 시작(The Beginning of Vector Concepts )

미리보기

08:51

부분공간: 벡터공간속의 벡터공간( Subspace: closed Vector space within a Vector Space)

12:00

일차결합 일차독립(Linear combination & linear independence)

09:27

기저와 벡터공간 차원(Basis and Vector Space Dimension )

16:32

내적(Inner product)

17:27

그램슈미트 직교화 과정(Gram-Schmidt Orthogonalization Process )

19:38

정리 1.30의 자세한 증명

11:23

섹션 2. 행렬을 바라보는 3가지 관점

8 강

∙ 1시간 13분

행렬을 바라보는 3가지 관점(Three Perspectives on Viewing Matrices )

미리보기

14:24

행렬: 벡터공간 사이의 함수(Matrix: Function between Vector Spaces)

13:39

벡터공간 연결함수 예제

06:54

행렬의 곱은 선형함수의 합성함수이다.(The multiplication of matrices is a composition of linear functions )

03:22

행렬의 랭크(rank of matrix)

11:35

행렬식(determinent)

14:58

직교행렬(orthogonal matrix)

05:23

벡터곱(cross product)

03:33

섹션 3. 고유값 고유벡터

6 강

∙ 1시간 11분

고유값 고유벡터(Eigen Value Eigen Vector)

14:02

행렬의 대각화 (Eigen Decomposition)

미리보기

14:15

대칭행렬의 대각화 1(매우 중요) (Diagonalization of a Symmetric Matrix)

11:17

대칭행렬의 대각화 2 (Diagonalization of a Symmetric Matrix)

13:19

양확정행렬(positive defininte matrix)

12:35

외적(outer product) &행렬의 제곱근(Square root of a matrix)

06:10

섹션 4. 마할라 노비스 거리

1 강

∙ 7분

마할라 노비스거리(Mahalanobis distance)

07:23

섹션 5. 행렬의 분해

3 강

∙ 30분

LU, LDU분해(LU, LDU decomposition)

미리보기

08:42

촐래스키 분해 QR분해(Cholesky, QR decomposition)

07:43

행렬의 특이값 분해( SVD : Singular Value Decomposition)

13:42

섹션 6. 선형방정식의 해구하는 방법

2 강

∙ 22분

특이값 분해를 이용한 선형방정식의 해 (Solution of Linear Equation using SVD)

12:34

정규방정식의 이용한 선형방정식의 해(Solution of Linear Equation using Normal Equation)

09:29

강의 게시일 : 2023년 11월 22일

(마지막 업데이트일 : 2023년 11월 22일)

수강평

수강생분들이 직접 작성하신 수강평입니다.

아직 평가를 충분히 받지 못한 강의 입니다.

모두에게 도움이 되는 수강평의 주인공이 되어주세요!😄️️

모두에게 도움이 되는 수강평의 주인공이 되어주세요!😄️️