테스트데이터셋 평가지표 값 문제

55

2 asked

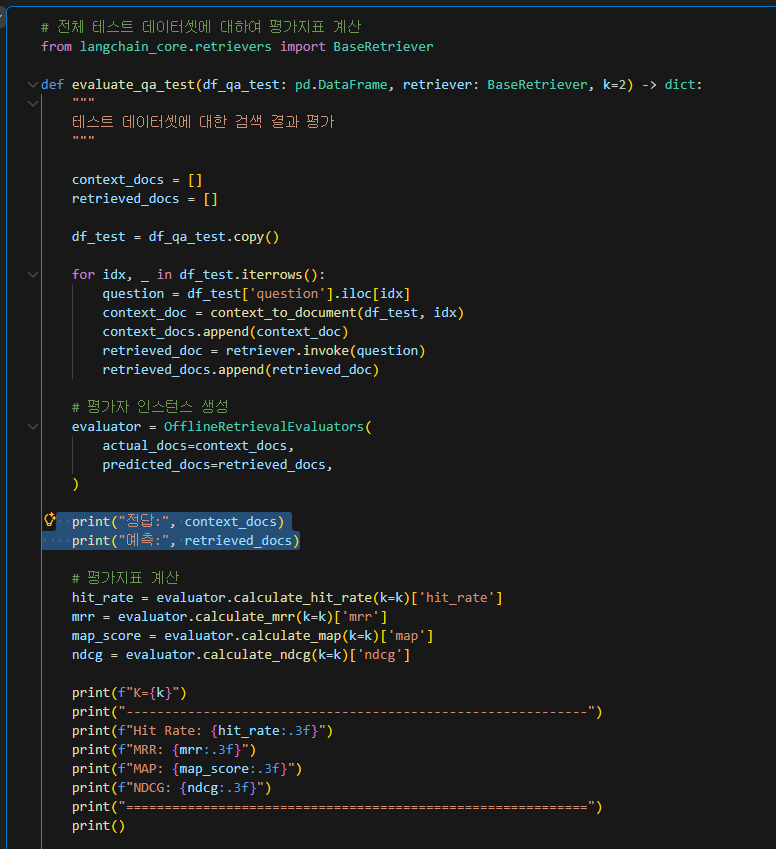

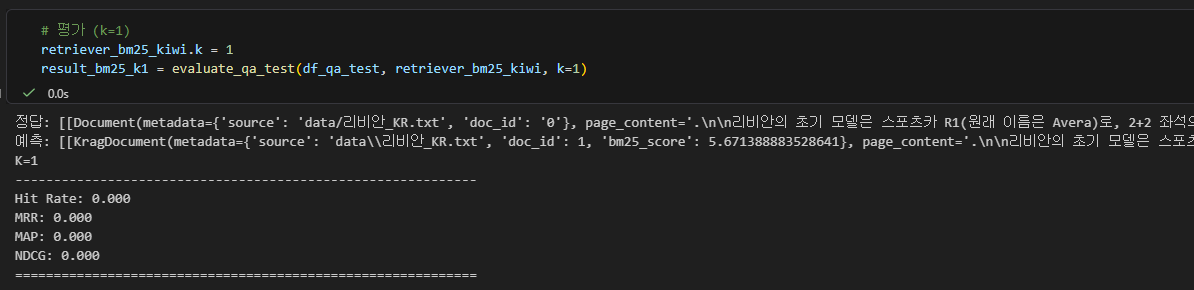

5분 경의 테스트데이터셋 평가 에 대해 계산값이 자꾸 0.000이 나와서 context_docs와 retrieved_docs 내용을 확인해 보니 2번째 사진과 같이 나왔습니다.

content 내용은 동일해도 doc_id 값이 다르며, 함수 수정을 통해 doc_id를 동일하게 변경해도 평가지표 값이 0.000이 나옵니다.

애초에 구조 자체가 좀 달라서 발생하는 문제 같습니다.

제가 어떤 것을 해볼 수 있을까요?

Answer 1

0

안녕하세요.

OfflineRetrievalEvaluators는 기본적으로 doc_id로 매칭합니다. context_docs와 retrieved_docs의 content가 같아도 doc_id가 다르면 전부 불일치로 평가지표가 0이 됩니다.

아래와 같이 matching_criteria=MatchingCriteria.PARTIAL을 추가하면 content 기반 매칭으로 전환됩니다.

from krag.evaluators import OfflineRetrievalEvaluators, MatchingCriteria

evaluator = OfflineRetrievalEvaluators(

actual_docs=context_docs,

predicted_docs=retrieved_docs,

matching_criteria=MatchingCriteria.PARTIAL # 이것만 추가

)

청크 크기 차이 등으로 content도 완전히 동일하지 않다면, ROUGE 기반 매칭을 쓸 수 있습니다.

from krag.evaluators import RougeOfflineRetrievalEvaluators, MatchingCriteria

evaluator = RougeOfflineRetrievalEvaluators(

actual_docs=context_docs,

predicted_docs=retrieved_docs,

matching_criteria=MatchingCriteria.PARTIAL,

match_method="rouge2",

threshold=0.8

)

언어 감지 및 검색 라우팅

0

55

2

동영상이 검은 화면으로 나옵니다.

0

70

2

강의가 진행되지 않습니다.

0

73

2

'팀 단위 AI 업무 혁신' 자문 관련하여 문의드리고자 합니다. (연락처 요청)

0

59

1

Rerank에 대해 질문드립니다.

0

69

2

Cross Encoder Reranker 임포트 에러 관련 내용입니다.

0

105

2

HuggingFaceCrossEncoder 임포트 에러

0

84

2

아나콘다랑 pytry없이. 단순 파이참에서 venv 설정해서 설치하는건 불가능하나요?

0

82

1

2.7 전체 RAG파이프라인 구성에서 4번째 줄 오류

0

82

1

rag 와 랭체인

0

118

2

score 기반 서치

0

50

2

KR.txt파일이 없습니다.

0

79

2

krag를 이용한 검색기법 평가관련 질문

0

78

2

MMR 관련 질문입니다.

0

84

1

Text_splitter관련 질문입니다.

0

63

2

오픈api key는 따로 구매해야되는 걸까요?

0

273

2

과거 채팅이력을 LLM에 줄때 포멧

0

75

1

OpenAIEmbeddings모델이 사용하는 토크나이저는 뭘까요?

0

177

2

ChatPromptTemplate의 from_messages로 메세지를 구성할 때 system은 어떻게 설정해야하나요?

0

100

2

create_retrieval_chain에서 context는 지정된 인자인가요?

0

64

1

vectorstore의 as_retriever와 similarity_search는 같은 로직인가요?, 사용되는 검색 알고리즘은 뭔가요?

0

98

2

evaluate_retrieval_at_K 함수 문의드립니다.

0

69

2

검색기 관련 질문드립니다.

0

91

2

2-3 임베딩모델 에러

0

172

2